L’essentiel en 30 secondes

Pour extraire les liens d’une page web, vous avez 3 options selon votre profil :

- 🎯 No-code (le plus simple) : Octoparse, gratuit, sans installation complexe

- ⚡ Extension Chrome (instantané) : Link Klipper, idéal pour une extraction rapide ponctuelle

- 🐍 Bibliothèque Python (pour développeurs) : Beautiful Soup, le plus flexible et personnalisable

Découvrez ci-dessous les 14 meilleurs extracteurs de liens testés en 2026, classés par type d’usage et niveau technique.

Quand a-t-on besoin de trouver des liens de site ?

Avez-vous déjà rencontré des situations où trouver des liens nécessaires, comme des liens manquants dans une campagne SEO ou des données incohérentes après une extraction massive ? Lorsqu’on doit aspirer des milliers d’URL en masse, comment éviter que des liens importants soient oubliés ou mal identifiés ?

Quels que soient les analystes SEO, les chercheurs des marketing digital ou les entrepreneurs, on a toujours besoin de trouver des liens de sites ciblés pour analyser la structure globale, alimenter la campagne de netlinking et réaliser la copie hors ligne. Les liens, ce sont les sources clés stratégiques pour toute démarche de veille concurrentielle du marché. Dans cet article, nous vous présenterons les TOP 14 extracteurs pour trouver des liens de la page.

Comment extraire les liens d’une page web en 3 étapes

Avant de plonger dans la liste détaillée des outils, voici la méthode la plus rapide et accessible — sans coder — pour extraire tous les liens d’une page web. Cette méthode s’applique à n’importe quel site, qu’il s’agisse d’un blog, d’un site e-commerce ou d’un annuaire en ligne.

Étape 1 : Choisir un extracteur adapté à votre niveau

Pour démarrer rapidement, Octoparse est l’outil recommandé : il est gratuit, sans code, et fonctionne sur Windows comme sur Mac. Téléchargez-le depuis le site officiel et créez un compte gratuit en moins d’une minute.

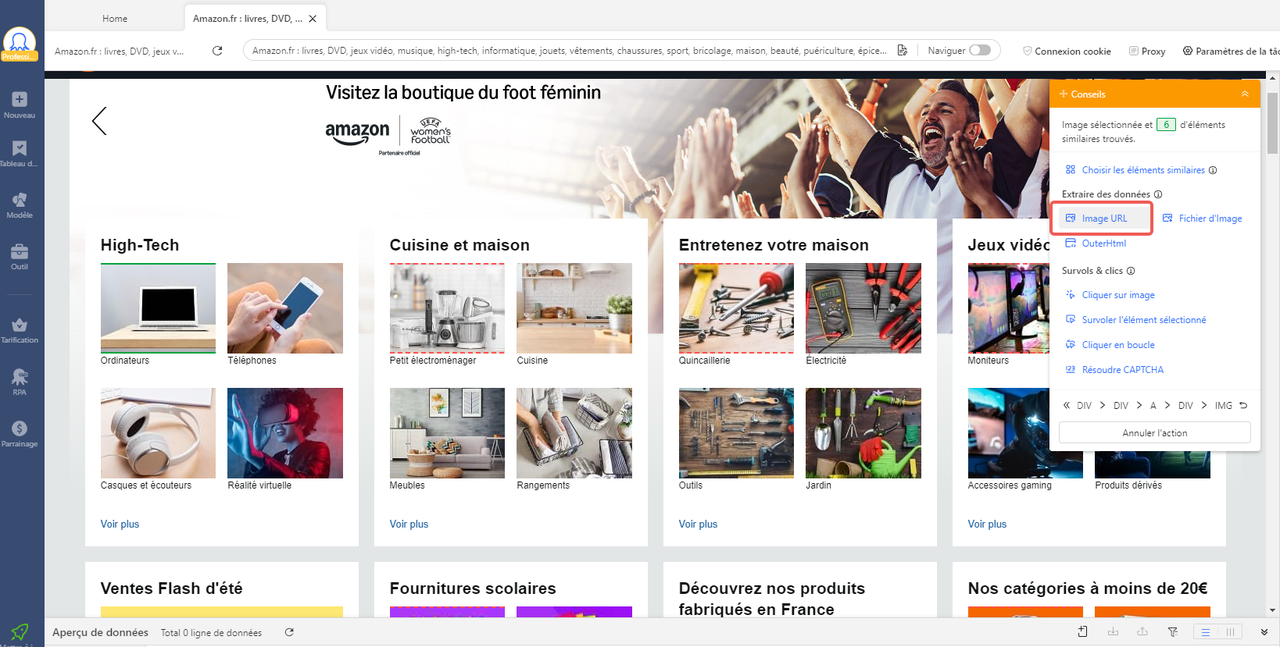

Étape 2 : Coller l’URL et sélectionner les liens à extraire

Lancez Octoparse, collez l’URL de la page cible dans la barre de recherche intégrée, puis cliquez sur “Démarrer”. L’outil chargera la page automatiquement. Cliquez ensuite sur n’importe quel lien visible : Octoparse détecte intelligemment tous les autres liens similaires sur la page. Dans le panneau de conseils à droite, sélectionnez “Extraire l’URL du lien” pour récupérer les hyperliens (et non le texte d’ancrage).

Étape 3 : Lancer l’extraction et exporter les résultats

Cliquez sur “Exécuter” pour démarrer l’extraction. Vous pouvez choisir d’exécuter le scraping localement ou dans le cloud (selon votre plan). Une fois terminé, exportez vos données au format Excel, CSV, JSON ou directement vers Google Sheets en un clic.

💡 Astuce : pour aspirer les liens de plusieurs pages d’un coup (par exemple toutes les pages d’un même domaine), consultez notre guide Aspirateur de site web : 6 logiciels testés. Pour extraire les données complètes d’un site (texte, prix, avis, images en plus des liens), Octoparse propose également des modèles préconfigurés.

Vous préférez une autre approche ? Découvrez ci-dessous les 14 meilleurs extracteurs classés par type — extensions Chrome, bibliothèques Python, plateformes professionnelles — pour choisir l’outil qui correspond à votre niveau technique et à votre budget.

14 meilleurs outils pour aspirer les URLs

Outils no-code du scraping de données

Octoparse

Octoparse est un extracteur de liens no-code, gratuit et complet, conçu pour les utilisateurs qui souhaitent collecter des URL en masse sans écrire la moindre ligne de code. Disponible sur Windows et Mac, il combine la simplicité d’une extension Chrome avec la puissance d’un véritable web scraper professionnel.

Comment Octoparse extrait les liens : il vous suffit de cliquer sur n’importe quel lien visible sur la page cible, puis de sélectionner “Extraire l’URL du lien” dans le panneau de conseils. Octoparse détecte automatiquement tous les liens similaires de la page et les extrait en quelques secondes.

Au-delà des liens classiques, Octoparse peut également récupérer :

- les URL d’images pour télécharger des images en masse

- les liens internes et externes d’un site complet

- les liens cachés chargés en JavaScript (impossible avec une simple extension Chrome)

- du contenu connexe (texte, tableaux, prix, avis) en une seule passe d’extraction

✓ Points forts : version gratuite suffisante pour démarrer, exécution dans le cloud, exports Excel/CSV/JSON/Google Sheets, modèles préconfigurés pour Amazon, Google Maps, LinkedIn, etc.

⚠ Points d’attention : la version gratuite limite le nombre de tâches mensuelles ; pour le scraping intensif, un plan payant est nécessaire.

👉 Idéal pour : les analystes SEO, les équipes commerciales (génération de leads), les e-commerçants en veille concurrentielle, et tous ceux qui veulent extraire des liens en masse sans coder.

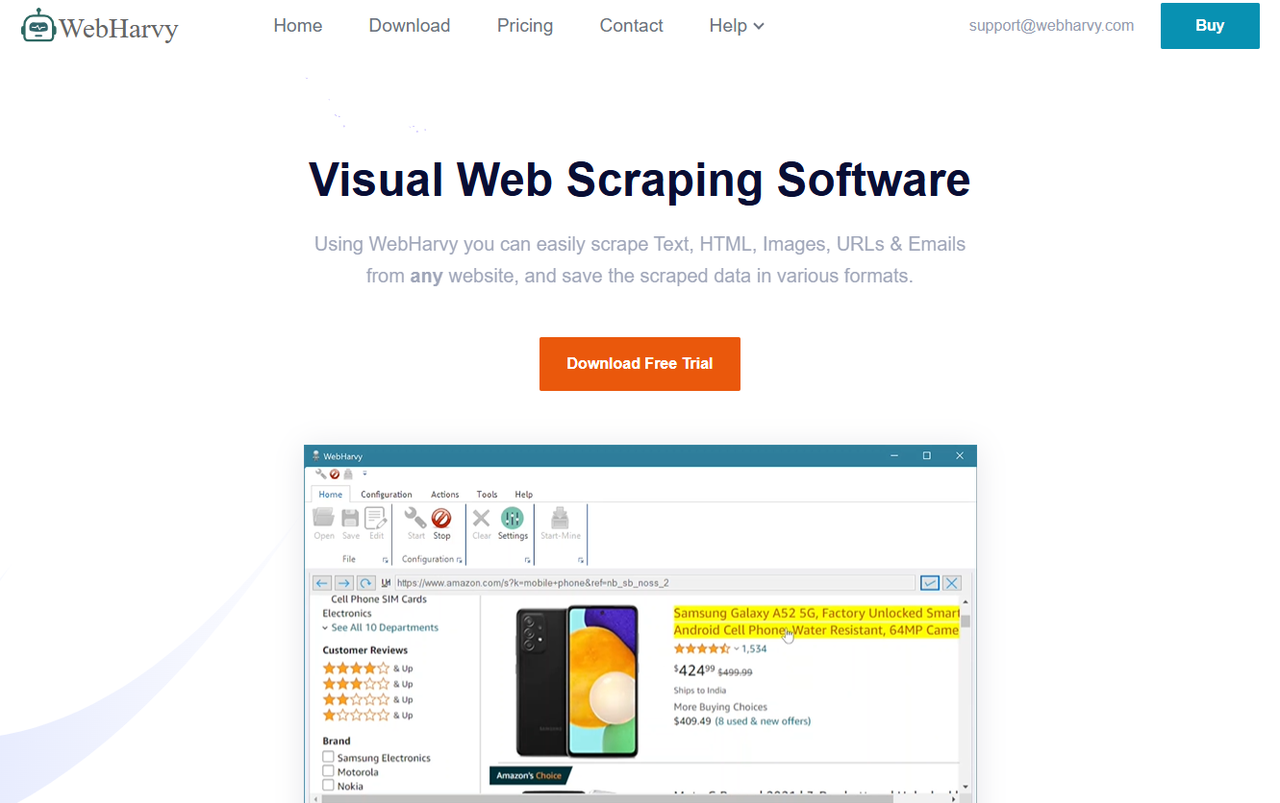

WebHarvy

WebHarvy est un logiciel de scraping web par pointer-cliquer qui permet aux utilisateurs d’extraire des données web, y compris des URL, en toute simplicité. Lorsque vous scrapez des URL à l’aide de WebHarvy, vous pouvez utiliser son expression régulière prédéfinie pour obtenir des liens à partir du code HTML plutôt que d’en écrire une vous-même.

L’outil supporte également l’extraction de pages chargées en JavaScript, la pagination automatique, et l’export aux formats CSV, Excel ou XML. WebHarvy fonctionne uniquement sur Windows et propose une licence à usage unique (à partir d’environ 129 $) plutôt qu’un abonnement mensuel — un modèle économique apprécié des utilisateurs occasionnels.

👉 Idéal pour : les utilisateurs Windows qui souhaitent un outil installé en local sans dépendance au cloud, et qui préfèrent un paiement unique à un abonnement.

Content Grabber

Content Grabber est un logiciel destiné à l’extraction de données à grande échelle. Il permet d’aspirer un site entier ou des pages spécifiques de manière automatisée, ce qui est utile pour collecter rapidement de grandes quantités d’informations structurées. L’outil offre des options avancées pour configurer les processus d’extraction, gérer des volumes importants de données, et exporter les résultats dans différents formats.

Son interface de scripting (en C# ou VB.NET) permet de personnaliser finement chaque tâche d’extraction, ce qui en fait l’un des outils les plus puissants pour des projets complexes. En revanche, Content Grabber est une solution professionnelle dont le prix démarre autour de plusieurs centaines d’euros par licence, ce qui le réserve aux entreprises avec des besoins récurrents et un budget conséquent.

👉 Idéal pour : les grandes entreprises et les agences qui ont besoin d’un scraping automatisé, planifié et à très grande échelle, avec une personnalisation poussée.

Extensions Chrome pour aspirer des liens

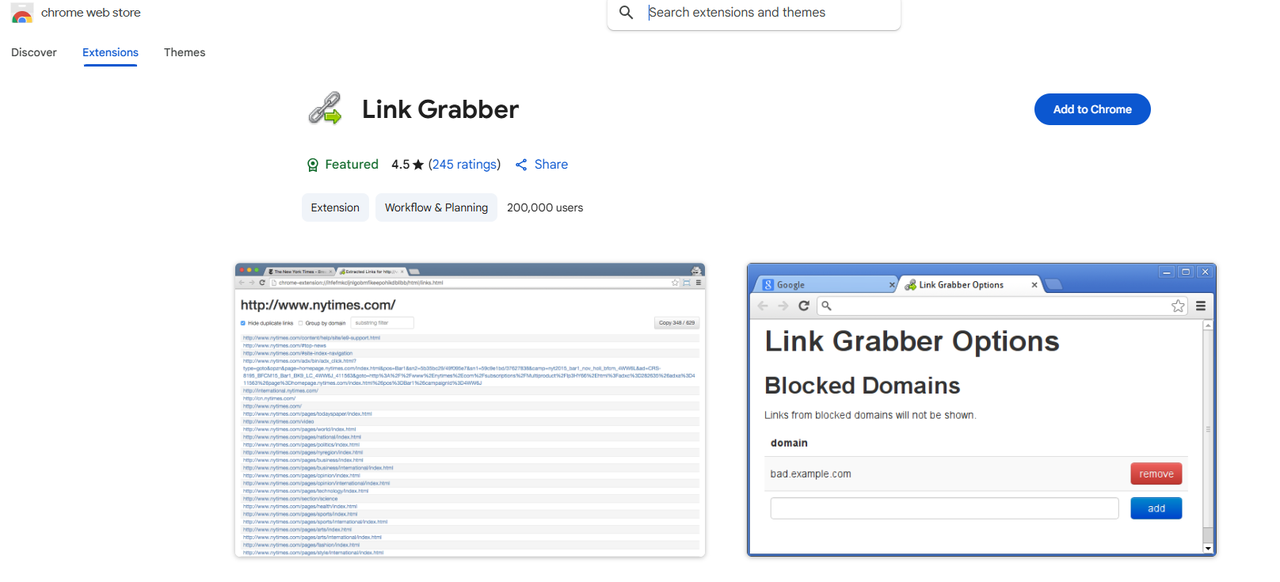

Link Grabber

Link Grabber est un extracteur spécialisé dans les liens hypertextes sur les pages HTML. Comme il s’agit d’une extension Chrome, il est léger et facile à utiliser : il suffit de l’installer depuis le Chrome Web Store, puis de cliquer sur son icône dans la barre d’outils pour récupérer instantanément tous les liens de la page active.

L’extension permet également de filtrer les liens par correspondance de chaîne de caractères et de regrouper les liens par domaine, ce qui vous fait gagner un temps précieux pour nettoyer les données extraites. Elle est entièrement gratuite et ne nécessite aucune inscription. Mais attention : Link Grabber ne peut extraire que des liens — si vous avez besoin de récupérer du texte, des images ou des prix en plus, ce n’est pas le meilleur choix.

👉 Idéal pour : une extraction ponctuelle et rapide de liens sur une seule page web, sans besoin d’extraire d’autres types de données.

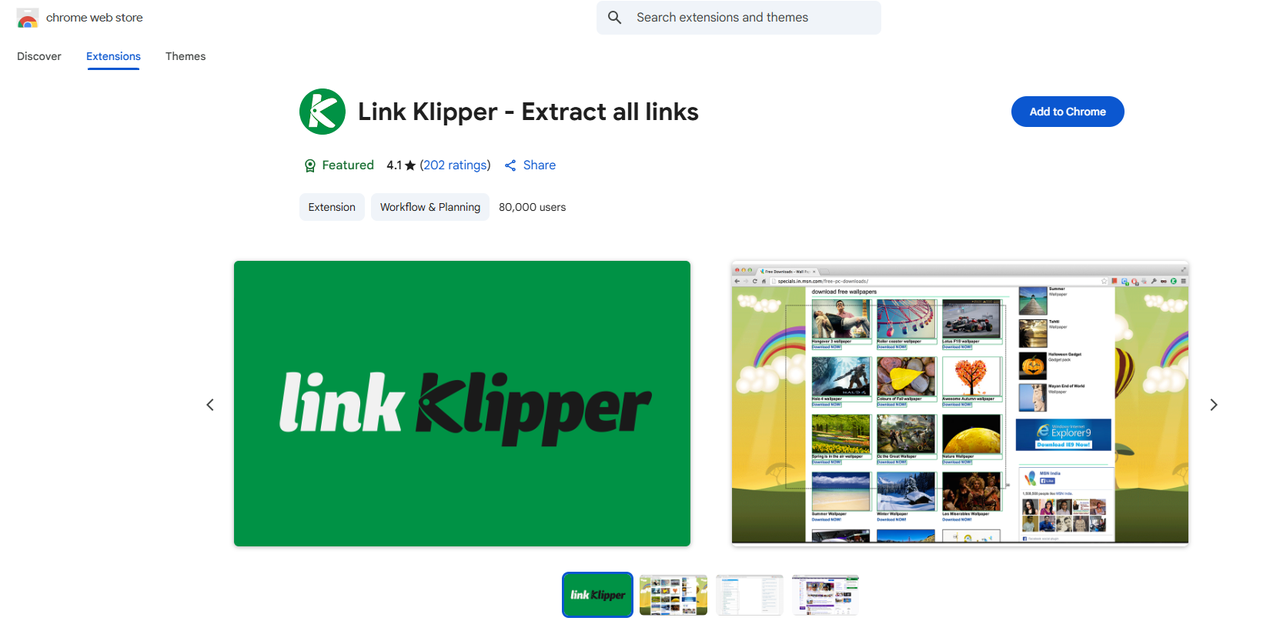

Link Klipper

Link Klipper est l’un des extracteurs de liens les plus populaires du Chrome Web Store, avec plus de 200 000 utilisateurs actifs et une note moyenne supérieure à 4,5 / 5. Simple mais puissant, il vous permet d’extraire tous les liens d’une page web et de les exporter dans un fichier en quelques clics.

Son atout principal : la possibilité de sélectionner manuellement une zone précise de la page (par exemple un menu, une liste de produits, un sitemap, un annuaire) plutôt que d’extraire tous les liens indistinctement. Cela permet de cibler exactement les liens utiles et d’éviter le bruit (liens de footer, mentions légales, etc.).

Toutefois, l’extension ne permet d’exporter les données qu’au format CSV. Si vous avez besoin d’autres formats (JSON, Excel) à des fins d’analyse, prévoyez du temps supplémentaire pour la conversion.

👉 Idéal pour : les utilisateurs réguliers qui font fréquemment de l’extraction ciblée sur des zones spécifiques de pages web et qui veulent un outil intégré directement dans leur navigateur.

Outils basés sur la programmation

Beautiful Soup (Python)

Beautiful Soup est une bibliothèque Python populaire qui permet d’extraire des données de fichiers HTML et XML. Elle peut bien gérer un HTML mal formaté et fournit une API simple et intuitive pour naviguer et extraire des données de documents HTML. Si vous êtes familier avec le codage Python, il peut s’agir d’une méthode flexible, gratuite et efficace pour récupérer des liens en masse.

Installation rapide : pip install beautifulsoup4 requests (la bibliothèque requests est nécessaire pour télécharger le contenu des pages avant analyse).

Voici un exemple de code qui montre comment Beautiful Soup récupère les liens d’un site web :

Bibliothèque entièrement open source, Beautiful Soup est largement documentée et bénéficie d’une communauté Python active depuis plus de 15 ans. C’est souvent le premier choix pour des projets de scraping de petite à moyenne envergure (jusqu’à quelques milliers de pages).

👉 Idéal pour : les développeurs Python débutants ou intermédiaires qui veulent un contrôle total sur le code, qui scrapent principalement des pages HTML statiques, et qui n’ont pas besoin de gérer des millions de pages à la fois.

Scrapy (Python)

Scrapy est un framework puissant et flexible d’exploration et de récupération de données sur le web, écrit en Python. Vous pouvez trouver dans Scrapy un ensemble complet d’outils pour l’extraction de données, y compris des liens. L’un des principaux avantages de Scrapy est qu’il est bien adapté aux tâches de scraping à grande échelle : il prend en charge le crawling distribué, gère efficacement les scénarios complexes (concurrence, cookies, limites de débit) et propose des pipelines d’export prêts à l’emploi (CSV, JSON, base de données).

Installation rapide : pip install scrapy

Vous trouverez ci-dessous un exemple de code pour l’extraction de liens à l’aide de Scrapy :

À la différence de Beautiful Soup, Scrapy fonctionne en mode asynchrone, ce qui permet de scraper plusieurs pages en parallèle et d’atteindre des débits de plusieurs milliers de pages par minute. La courbe d’apprentissage est plus raide (notion de spider, de pipeline, de middleware), mais les performances sont incomparables sur des projets industriels.

👉 Idéal pour : les développeurs Python expérimentés qui mènent des projets de scraping à grande échelle (millions de pages) et qui ont besoin d’un crawling structuré, performant et maintenable sur le long terme.

Selenium (multi-langues)

Selenium est à l’origine un outil d’automatisation web utilisé pour tester des applications, disponible en plusieurs langages (Python, Java, JavaScript, C#, Ruby). Mais il peut également être utilisé pour des tâches de web scraping, en particulier sur les sites lourdement chargés en JavaScript (single-page applications, contenu dynamique, infinite scroll) où Beautiful Soup et Scrapy atteignent leurs limites.

Installation rapide (Python) : pip install selenium webdriver-manager

Par rapport à d’autres bibliothèques Python, Selenium simule un vrai navigateur (Chrome, Firefox, Edge), ce qui visualise le processus de scraping et facilite le débogage et la vérification des liens extraits. C’est aussi pratique pour gérer les pages qui exigent une connexion préalable ou des interactions complexes (clic sur un bouton, défilement, formulaire).

Voici un exemple de code Python pour extraire les liens avec Selenium :

Cependant, en termes de vitesse de scraping, Selenium est nettement plus lent que Beautiful Soup ou Scrapy, en particulier pour les tâches de scraping à grande échelle. Il consomme aussi davantage de ressources (RAM, CPU) car il lance un navigateur complet pour chaque session de scraping.

👉 Idéal pour : les développeurs qui doivent extraire des liens depuis des sites web complexes (JavaScript dynamique, contenu chargé en AJAX, login obligatoire) et qui privilégient la fidélité d’exécution sur la vitesse.

Les plateformes pour l’application variée

Bright Data

Bright Data (anciennement Luminati) est l’un des leaders mondiaux de la collecte de données web pour les entreprises B2B. La plateforme met à disposition divers outils et API pour répondre à des besoins de scraping à grande échelle : Web Scraper IDE, Datasets, SERP API, Web Unlocker, et un réseau de proxies de plus de 72 millions d’IP résidentielles pour contourner les blocages géographiques.

L’URL Scraper de Bright Data est un produit prédéfini que vous pouvez utiliser pour collecter des URL à partir de sites de commerce électronique, de médias sociaux, de sites Web immobiliers, etc. La plateforme garantit une conformité RGPD et CCPA stricte, ce qui en fait un choix prisé des grandes entreprises avec des contraintes légales fortes.

Mais attention au coût : les tarifs commencent autour de 500 $/mois pour des usages sérieux, ce qui en fait une solution réservée aux entreprises avec des besoins importants ou intensifs.

👉 Idéal pour : les grandes entreprises et agences qui ont des besoins de scraping massif (millions d’URL/mois), des contraintes de conformité RGPD strictes, et un budget conséquent.

Apify

Apify est une plateforme cloud de scraping web orientée vers les développeurs. Elle propose un catalogue d’Actors — des modules de scraping préconfigurés pour quelques sites populaires (Google, Amazon, Instagram, LinkedIn) — ainsi qu’un SDK Node.js et Python pour ceux qui souhaitent construire leurs propres scrapers.

L’utilisation pleine de la plateforme demande cependant une certaine familiarité avec le code : le concept d’Actors propre à Apify, la manipulation de scripts JavaScript ou Python pour personnaliser un module, et la configuration de chaînes d’extraction restent relativement techniques. La qualité des Actors varie également selon les développeurs tiers qui les publient — un module populaire ne correspondra pas forcément à votre site cible spécifique.

Tarification : modèle de crédits à l’usage qui peut être difficile à anticiper en début de projet. Un plan gratuit avec 5 $ de crédits mensuels est inclus pour tester. Les plans payants commencent à 49 $/mois, mais le coût réel dépend du nombre d’Actors exécutés et de leur consommation — certains Actors tiers étant facturés en supplément du plan de base.

👉 Idéal pour : les équipes techniques disposant d’un développeur en interne, à l’aise avec un environnement cloud orienté code, et qui ont besoin d’un Actor spécifique déjà disponible sur la marketplace.

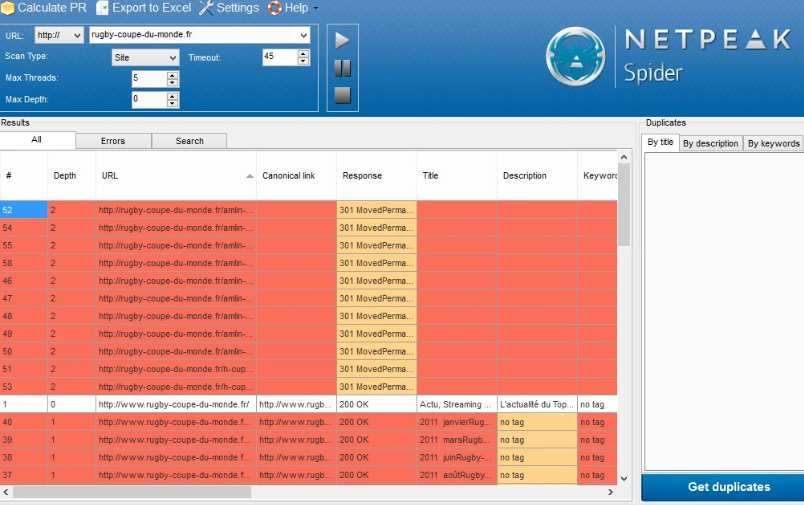

Netpeak Spider

Netpeak Spider est un crawler SEO de bureau (desktop) puissant, spécifiquement conçu pour les audits techniques et l’analyse de structure de liens. Contrairement aux extracteurs généralistes, il se concentre sur les besoins SEO : aspirer tous les liens d’un site web, détecter les liens cassés, analyser les redirections, identifier les pages orphelines, et calculer le PageRank interne.

Il fournit également des données précieuses pour le netlinking : liens internes vs externes, anchor text, attributs nofollow/dofollow, et profondeur de chaque page dans l’arborescence. Compatible Windows uniquement, il analyse jusqu’à 200 paramètres SEO par page.

Tarification : version d’essai gratuite limitée à quelques centaines d’URL par crawl, plans payants à partir d’environ 19 $/mois. Très utilisé dans le scraping de données de référencement pour aspirer rapidement un site entier.

👉 Idéal pour : les consultants SEO, les audits techniques de site, et toute personne qui veut analyser la structure de liens internes/externes d’un site web pour optimiser son netlinking.

ParseHub

ParseHub est une plateforme de web scraping qui permet d’extraire des liens et du contenu dynamique de sites web complexes. Elle dispose d’une interface graphique par pointer-cliquer qui facilite la configuration des projets de scraping, même pour des sites nécessitant une gestion particulière du contenu interactif ou chargé en JavaScript (single-page applications, dropdowns, formulaires, infinite scroll).

L’outil utilise des algorithmes de détection automatique pour identifier les patterns de données sur une page, ce qui réduit considérablement le temps de configuration. Il supporte également la pagination automatique, le scraping conditionnel et l’extraction depuis des fichiers PDF.

Tarification : version gratuite avec une limite de 200 pages par crawl, plans payants à partir d’environ 189 $/mois. Disponible sur Windows, Mac et Linux. Les exports se font en CSV, Excel, JSON, ou directement via API.

👉 Idéal pour : les utilisateurs non-techniques qui ont besoin de scraper des sites web complexes avec beaucoup de JavaScript, et qui veulent une interface graphique intuitive plutôt qu’écrire du code.

HTTrack

HTTrack est un logiciel open source et entièrement gratuit permettant de télécharger une copie complète d’un site web pour une consultation hors ligne. Il facilite la récupération de toutes les pages, images, fichiers CSS, JavaScript, liens et autres éléments du site, afin de créer une copie locale fidèle utilisable ultérieurement.

Sa principale force est sa capacité à reconstruire la structure relative des liens d’un site complet : tous les liens internes du site copié pointent correctement vers les fichiers locaux, ce qui rend la version offline parfaitement navigable. C’est l’outil de référence depuis plus de 25 ans pour cette tâche, avec une communauté active et une documentation abondante.

Limites : HTTrack ne gère pas bien les sites fortement chargés en JavaScript (single-page applications), car il ne rend pas le DOM dynamique. Disponible sur Windows, Linux et BSD.

👉 Idéal pour : la copie hors ligne d’un site web complet (consultation offline, archivage, sauvegarde), particulièrement pour des sites traditionnels en HTML statique ou semi-dynamique. Pour comparer HTTrack à d’autres outils similaires, consultez notre guide Aspirateur de site web : 6 logiciels testés.

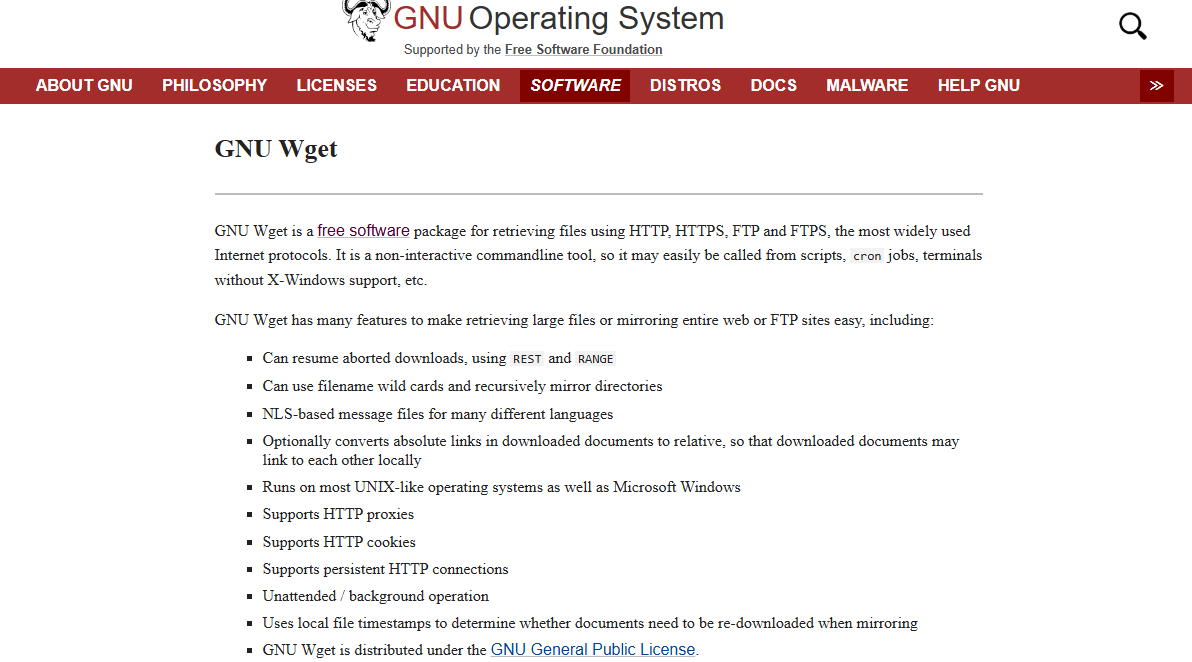

GNU Wget

GNU Wget est un utilitaire en ligne de commande gratuit et open source conçu pour télécharger du contenu depuis Internet. Préinstallé sur la plupart des systèmes Linux et macOS (et facilement installable sur Windows), il permet d’aspirer efficacement un site web entier ou une liste spécifique d’URL, en gérant intelligemment la reprise des téléchargements en cas d’interruption.

Exemple d’utilisation pour télécharger un site complet en mode récursif :

Wget supporte les protocoles HTTP, HTTPS et FTP, gère les cookies, l’authentification, et permet de définir des limites de bande passante pour ne pas surcharger le serveur cible. Outil léger, scriptable et automatisable, il s’intègre parfaitement dans des pipelines de production.

Limites : pas d’interface graphique (CLI uniquement), pas de gestion du JavaScript dynamique. La maîtrise des options nécessite une bonne familiarité avec le terminal.

👉 Idéal pour : les administrateurs système, les développeurs et les utilisateurs avancés qui veulent automatiser des téléchargements dans des scripts shell, ou archiver des sites web avec un contrôle fin via la ligne de commande.

Comparatif des 14 extracteurs de liens : tableau récapitulatif

Pour vous aider à choisir l’outil adapté à votre profil, voici une synthèse comparative des 14 extracteurs de liens présentés dans cet article. Le tableau se lit en croisant deux critères principaux : votre niveau technique (sans code vs avec code) et votre budget (gratuit, licence unique, ou abonnement).

| Outil | Type | Prix | Sans code | Idéal pour |

|---|---|---|---|---|

| 🏆 Octoparse | Desktop + Cloud | Gratuit + plans payants | ✅ Oui | Tous profils, extraction massive |

| WebHarvy | Desktop (Windows) | Licence unique (~129 $) | ✅ Oui | Utilisateurs Windows, paiement unique |

| Content Grabber | Desktop pro | Licence pro (centaines €) | Partiellement | Grandes entreprises, projets complexes |

| Link Grabber | Extension Chrome | Gratuit | ✅ Oui | Extraction simple et ponctuelle |

| Link Klipper | Extension Chrome | Gratuit | ✅ Oui | Extraction ciblée par zone |

| Beautiful Soup | Bibliothèque Python | Gratuit (open source) | ❌ Non | Développeurs Python débutants |

| Scrapy | Framework Python | Gratuit (open source) | ❌ Non | Scraping à grande échelle |

| Selenium | Multi-langues | Gratuit (open source) | ❌ Non | Sites JavaScript dynamiques |

| Bright Data | Plateforme cloud B2B | À partir de ~500 $/mois | Partiellement | Très grandes entreprises, RGPD strict |

| Apify | Plateforme cloud | À partir de 49 $/mois | Partiellement | Équipes techniques avec développeur |

| Netpeak Spider | Crawler SEO desktop | À partir de ~19 $/mois | ✅ Oui | Audits SEO et analyse de structure |

| ParseHub | Cloud + Desktop | À partir de ~189 $/mois | ✅ Oui | Sites complexes en JavaScript |

| HTTrack | Logiciel open source | Gratuit | ✅ Oui | Copie hors ligne d’un site complet |

| GNU Wget | Utilitaire en ligne de commande | Gratuit (open source) | ❌ Non | Automation via terminal et scripts |

Comment lire ce tableau

- Sans code = ✅ Oui : vous pouvez utiliser l’outil immédiatement, sans aucune connaissance en programmation

- Sans code = Partiellement : l’outil propose une interface visuelle pour les usages basiques, mais une partie des fonctionnalités avancées nécessite de coder ou de comprendre des concepts techniques

- Sans code = ❌ Non : connaissances en programmation requises (Python, JavaScript, ligne de commande, etc.)

Quel extracteur choisir si vous hésitez ?

Si vous cherchez un point de départ universel, qui combine simplicité (sans code), prix abordable (version gratuite suffisante pour démarrer), polyvalence (liens, images, contenus) et capacité à monter en charge sans changer d’outil, Octoparse est l’option recommandée par défaut. Vous pouvez tester la version gratuite en quelques minutes et basculer vers un plan payant uniquement si vos besoins le justifient.

Pour des cas d’usage très spécifiques (scraping massif B2B, audit SEO pur, copie hors ligne), reportez-vous au tableau ci-dessus pour identifier l’outil le plus adapté.

Transformer les sites web vers Excel, CSV, Google Sheets ou base de données.

Auto-détecter les sites Web et extraire les données sans aucun codage.

Scraper les sites populaires en quelques clics avec les modèles pré-construits.

Ne se trouver jamais bloqué grâce aux proxies IP et à l’API avancée.

Service Cloud pour programmer le scraping de données.

Quel extracteur de liens choisir selon votre besoin ?

Le tableau comparatif vous donne une vue d’ensemble, mais le choix concret dépend de votre profil et de votre cas d’usage. Voici une grille de décision rapide pour vous orienter en quelques secondes.

Vous êtes débutant et n’avez jamais fait de scraping

Privilégiez un outil sans code avec une courbe d’apprentissage minimale :

- Pour démarrer en 5 minutes : Octoparse — interface visuelle, modèles préconfigurés pour Amazon, Google Maps, LinkedIn, version gratuite suffisante pour vos premiers tests

- Pour une extraction ponctuelle d’une seule page : Link Klipper — extension Chrome, aucune installation lourde

Vous êtes développeur et préférez coder

Choisissez selon la taille de votre projet :

- Petits projets (< 10 000 pages) : Beautiful Soup — simple, bien documenté, parfait pour apprendre

- Projets industriels (millions de pages) : Scrapy — framework asynchrone, conçu pour la production

- Sites lourdement JavaScript : Selenium — simulation de navigateur réel

Vous avez des besoins SEO (audit, netlinking, veille)

- Audit technique pur d’un site : Netpeak Spider — spécialisé SEO, identifie liens cassés, redirections, pages orphelines

- Extraction de liens + données concurrentielles (prix, avis, contenu) : Octoparse — modèles préconfigurés pour les principaux sites e-commerce et réseaux sociaux

Vous voulez télécharger une copie hors ligne d’un site

- Site classique en HTML : HTTrack — référence open source pour la copie offline depuis 25 ans

- Automation via scripts : GNU Wget — léger, en ligne de commande, intégrable dans des pipelines

Pour comparer ces outils plus en détail, consultez notre guide dédié : Aspirateur de site web : 6 logiciels testés.

Vous êtes une grande entreprise avec des contraintes RGPD strictes

- Scraping massif (millions d’URL/mois) : Bright Data — réseau de 72 millions d’IP résidentielles, conformité RGPD/CCPA

- Alternative avec budget maîtrisé : Octoparse en plan Premium ou Enterprise — pricing prévisible, support dédié

Vous gérez des sites complexes avec beaucoup de JavaScript

- Sans coder : ParseHub — détection automatique des patterns avec algorithmes ML

- En codant : Selenium — contrôle total via simulation de navigateur

Pour la majorité des cas d’usage

Si vous hésitez entre plusieurs options ou si vous voulez un outil polyvalent qui couvre 80 % des besoins sans avoir à apprendre plusieurs solutions différentes, Octoparse reste l’option la plus équilibrée : sans code, gratuit pour démarrer, capable de monter en charge avec un plan payant, et compatible avec tous les types de sites (statiques, dynamiques, e-commerce, réseaux sociaux). Pour extraire les données complètes d’un site au-delà des seuls liens, Octoparse propose également des modèles dédiés.

Techniques pour optimiser le scraping de données

Pour maximiser l’efficacité du scraping de données, il est recommandé de combiner différents outils selon vos besoins. L’usage de filtres et de critères de sélection permet aussi de trouver des liens ou pages qui vous intéressent, réduisant ainsi le volume de données inutiles. Pour aspirer un site complexe ou volumineux, il est recommandé d’adopter une approche structurée : planifier des crawlings progressifs, définir des priorités, et ajuster la configuration en fonction de la structure du site. Ces méthodes contribuent à améliorer la rapidité, la précision et la fiabilité du processus de scraping.

FAQ : Extracteur de liens

- Comment extraire tous les liens d’une page web ?

La méthode la plus simple est d’utiliser un outil sans code comme Octoparse : collez l’URL de la page cible, cliquez sur n’importe quel lien visible, sélectionnez “Extraire l’URL du lien” dans le panneau de conseils, puis exportez les résultats en CSV ou Excel. Cette opération prend moins de 5 minutes pour une page standard. Pour les développeurs, des bibliothèques Python comme Beautiful Soup permettent de récupérer tous les liens en quelques lignes de code.

- Quel est le meilleur extracteur de liens gratuit en 2026 ?

Pour une utilisation gratuite et sans code, Octoparse est l’option la plus complète : sa version gratuite permet d’extraire des liens en masse, avec des modèles préconfigurés et un support multi-plateformes (Windows + Mac). Pour une extraction ponctuelle dans le navigateur, Link Klipper et Link Grabber (extensions Chrome) sont également gratuits. Côté code, Beautiful Soup et Scrapy sont des bibliothèques Python entièrement open source.

- Comment extraire les liens d’un site web sans coder ?

Trois solutions principales existent sans aucune connaissance en programmation : (1) un logiciel sans code comme Octoparse ou WebHarvy, qui propose une interface visuelle par pointer-cliquer ; (2) une extension Chrome comme Link Klipper, idéale pour une extraction ponctuelle ; (3) une plateforme cloud avec interface graphique comme ParseHub. Octoparse reste le plus polyvalent des trois pour les utilisateurs débutants, car il combine simplicité et capacité à gérer des sites complexes.

- Peut-on extraire les liens de plusieurs pages d’un coup ?

Oui, mais cela nécessite un outil capable de gérer la pagination automatique ou le crawling récursif. Les extensions Chrome basiques (Link Grabber, Link Klipper) ne fonctionnent que sur la page active. En revanche, Octoparse, Scrapy, HTTrack ou GNU Wget peuvent parcourir un site entier et extraire les liens de toutes les pages en une seule passe. Pour aspirer un site complet, consultez notre guide Aspirateur de site web : 6 logiciels testés.

- Quelle différence entre liens internes et liens externes ?

Les liens internes pointent vers d’autres pages du même domaine (par exemple, un lien d’un article de blog vers une page produit du même site). Les liens externes pointent vers des pages d’autres domaines. La distinction est importante en SEO : les liens internes structurent l’architecture d’un site et distribuent le PageRank, tandis que les liens externes (entrants ou sortants) influencent l’autorité globale du site. La plupart des extracteurs de liens permettent de filtrer par type (internes ou externes), notamment Netpeak Spider pour les audits SEO et Octoparse pour les besoins polyvalents.

- Est-il légal d’extraire les liens d’un site web ?

En général, extraire des liens publiquement accessibles est légal dans la plupart des pays, y compris en France et dans l’Union européenne. Cependant, plusieurs règles doivent être respectées : (1) consulter le fichier robots.txt du site cible et respecter ses directives, (2) lire les conditions d’utilisation (CGU) du site, (3) ne pas surcharger le serveur (espacer les requêtes), (4) ne pas extraire de données personnelles sans base légale au sens du RGPD. Pour un usage commercial intensif, il est recommandé de consulter un juriste spécialisé.

En conclusion

L’extraction de liens est un levier essentiel pour de nombreuses activités : analyse SEO, génération de leads B2B, veille concurrentielle, audit technique, ou simple archivage. Avec les 14 outils présentés dans cet article — du sans-code grand public aux frameworks Python avancés — vous disposez désormais d’une vision complète des solutions disponibles en 2026.

Pour la majorité des utilisateurs, un outil sans code comme Octoparse constitue le meilleur point de départ : il vous permet d’extraire des liens en quelques clics, sans installation complexe ni connaissances techniques, et reste suffisant pour 80 % des besoins courants. Pour les cas plus spécifiques (scraping à très grande échelle, audit SEO spécialisé, copie hors ligne), reportez-vous au comparatif et au guide de décision plus haut dans l’article.

🚀 Prêt à démarrer ? Téléchargez Octoparse gratuitement et extrayez vos premiers liens en moins de 5 minutes — aucune carte bancaire requise.