Extraire des données d’un site web vers Excel revient à un besoin précis : récupérer automatiquement des informations publiées en ligne, que ce soit des prix de produits sur Fnac ou Cdiscount, des annonces immobilières sur SeLoger, des offres d’emploi sur Welcome to the Jungle ou des contacts professionnels sur des annuaires sectoriels.

Le copier-coller manuel reste possible pour quelques dizaines de lignes. Au-delà, il devient une source d’erreurs, de temps perdu et de données obsolètes dès la semaine suivante.

Il existe plusieurs façons d’automatiser cette extraction, selon votre niveau technique et le type de données ciblées :

- Un outil de web scraping no-code : la solution la plus rapide pour les non-développeurs

- Power Query dans Excel : intégré à Excel, idéal pour les tableaux HTML statiques

- Google Sheets avec IMPORTHTML : gratuit, sans installation, directement dans le navigateur

- VBA dans Excel : pour les utilisateurs à l’aise avec la programmation Office

Le guide ci-dessous part de la méthode la plus rapide à mettre en place et monte progressivement vers les options les plus techniques.

Qu’est-ce que le web scraping vers Excel ?

Le web scraping Excel désigne l’extraction automatique de données depuis des pages web, directement structurées dans un tableau Excel prêt à filtrer, trier et analyser.

Si vous avez déjà copié-collé un tableau depuis une page web vers Excel, vous avez fait du web scraping à la main. La différence : ici, tout est automatisé, même quand il y a des centaines ou des milliers de lignes, et même quand la page évolue chaque semaine.

Quand le web scraping vers Excel est-il utile ?

Voici les cas les plus fréquents dans le contexte français :

- Veille tarifaire e-commerce : suivre les prix de Fnac, Cdiscount ou ManoMano sur des centaines de références

- Immobilier : agréger les annonces SeLoger ou Leboncoin par ville, surface, prix

- Génération de leads : collecter des contacts d’entreprises depuis PagesJaunes ou des annuaires sectoriels

- Analyse RH / recrutement : surveiller les offres d’emploi Welcome to the Jungle, Indeed France

- Études de marché : consolider des données publiques issues de plusieurs sources

Méthode 1 : extraire des données vers Excel avec un outil de web scraping no-code

Le web scraping Excel consiste à automatiser la collecte de données depuis des sites web pour les structurer directement dans un tableur. C’est la méthode la plus efficace quand le site cible utilise du JavaScript pour afficher ses données, quand la pagination est automatique, ou quand vous avez besoin de résultats réguliers sans intervention manuelle.

Les outils no-code permettent de scraper n’importe quel site en quelques clics, sans écrire une ligne de code. Parmi les solutions disponibles, voici celles qui sont réellement utilisées par des équipes françaises en 2026 :

Comparatif rapide des outils de web scraping no-code

| Outil | Type | Export Excel | Adapté aux débutants | Particularité |

| Octoparse | Desktop + Cloud | Oui | Oui | Autodétection, templates prêts, scraping planifié |

| WebScraper.io | Extension Chrome | (CSV/Excel) | Oui | Gratuit pour l’usage basique |

| Bardeen | Extension Chrome | Oui | Oui | Automatisation workflow + scraping |

| ParseHub | Desktop | Oui | Moyen | Bonne gestion du JavaScript dynamique |

Comment extraire des données vers Excel en 3 étapes avec Octoparse

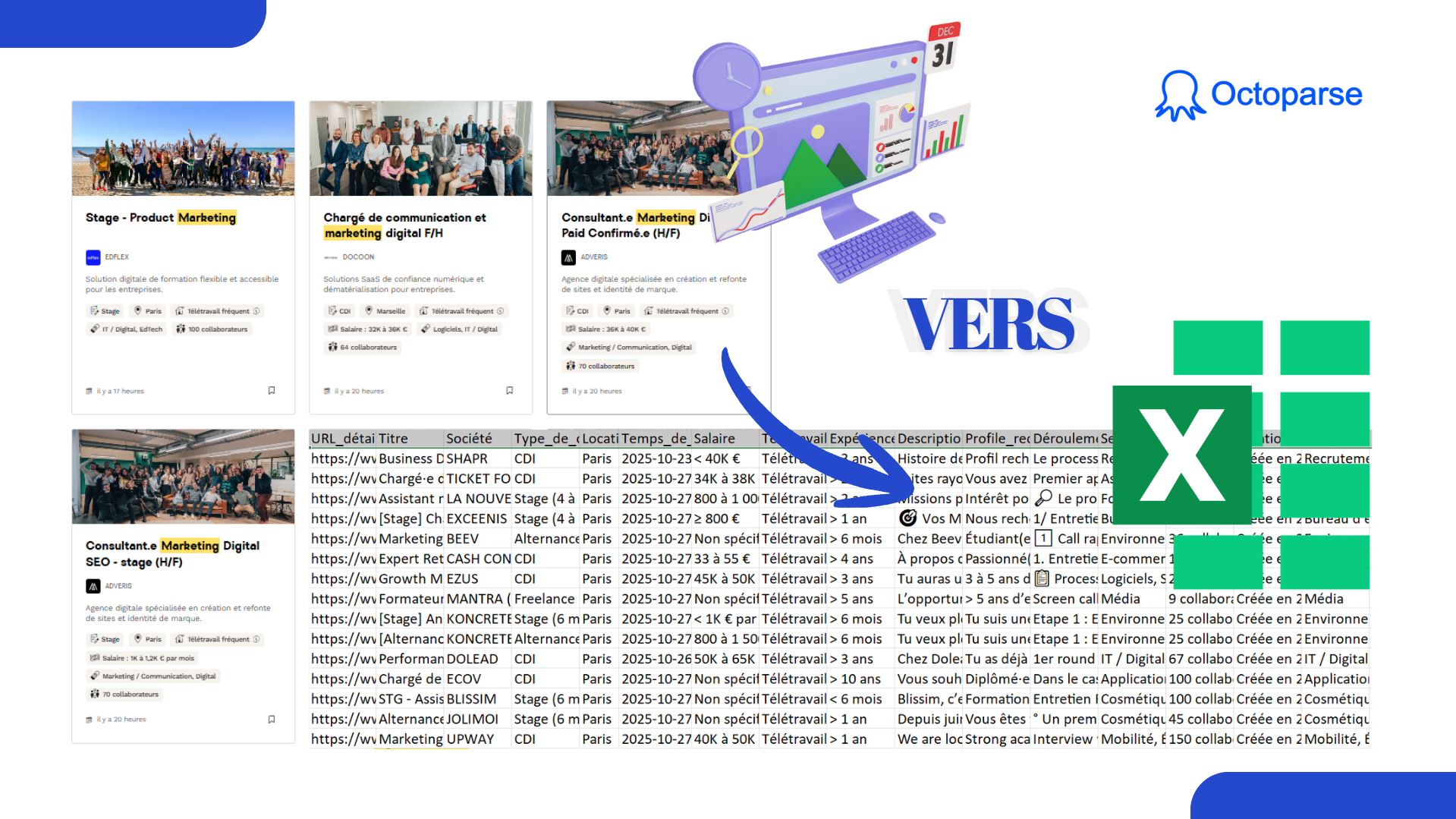

Prenons un exemple concret : récupérer les offres d’emploi marketing à Paris depuis Welcome to the Jungle, l’une des plateformes de recrutement les plus utilisées en France.

Étape 1 : Démarrer la tâche

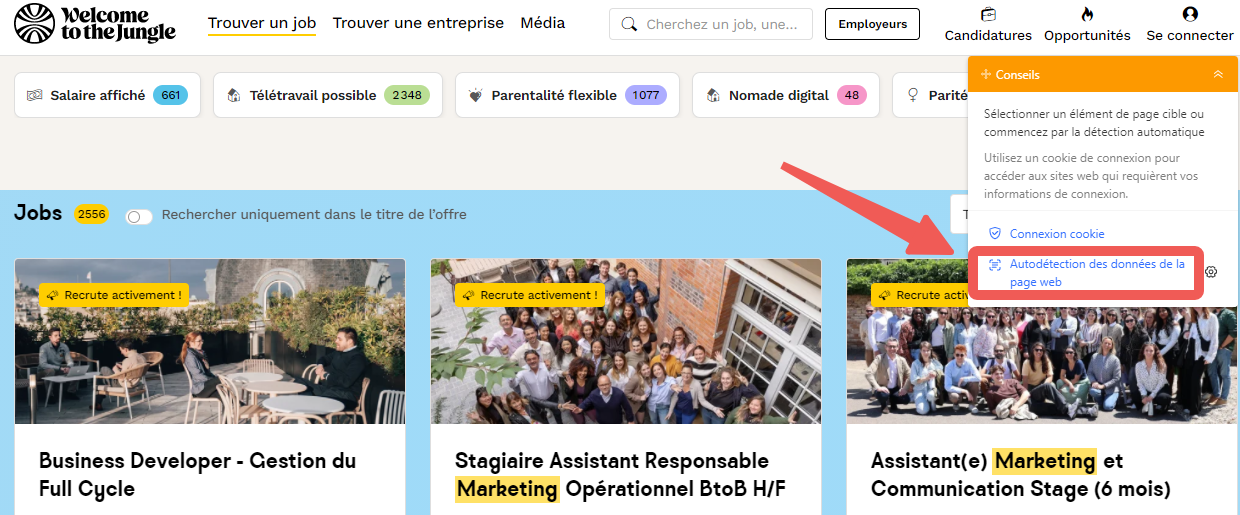

Après avoir lancé votre recherche sur Welcome to the Jungle (par exemple, postes marketing en Île-de-France), copiez l’URL de la page de résultats et collez-la dans Octoparse. Cliquez sur Démarrer pour initialiser la collecte.

Étape 2 : Lancer l’autodétection

Cliquez sur Autodétection des données. Octoparse analyse la page et identifie automatiquement les champs pertinents : titre du poste, entreprise, localisation, type de contrat. Aucune sélection manuelle nécessaire.

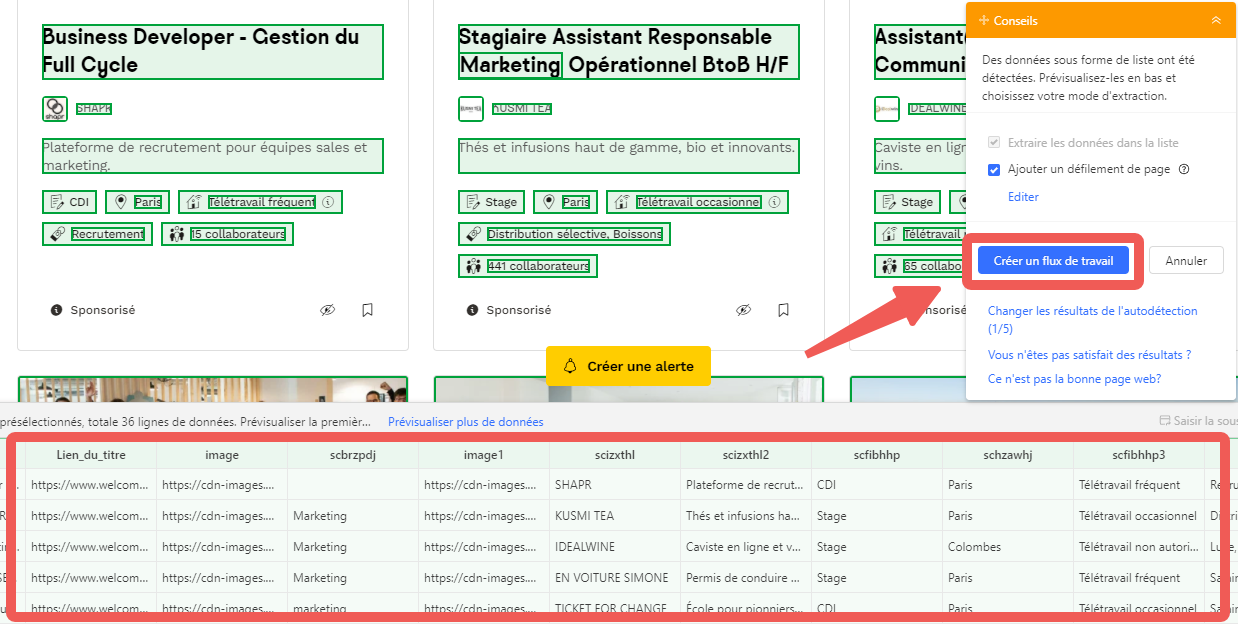

Étape 3 : Créer le flux et exporter

Sélectionnez Créer un flux de travail, ajustez ou supprimez les champs si besoin, puis cliquez sur Exécuter. Une fois la collecte terminée, exportez directement en fichier Excel ou Google Sheets.

Les templates Octoparse pour les sites français

Pour les sites les plus utilisés en France, Octoparse propose des templates prêts à l’emploi qui évitent toute configuration. Voici ceux directement pertinents pour le marché français :

- Leboncoin Data Scraper : titre, prix, adresse, description des annonces, etc.

https://www.octoparse.fr/template/leboncoin-data-scraper

- Welcome to the Jungle Offres d’emploi Scraper : offres d’emploi avec tous les champs structurés, etc.

https://www.octoparse.fr/template/wttj-offres-scraper

- Vinted Scraper Avancé : titre de l’annonce, prix, taille, état, vendeur (seconde main mode et accessoires), etc.

https://www.octoparse.fr/template/vinted_data_scraper_by_url

- Pagesjaunes Business Info Scraper : noms, téléphones, adresses d’entreprises, etc.

https://www.octoparse.fr/template/pagesjaunes-business-info-scraper

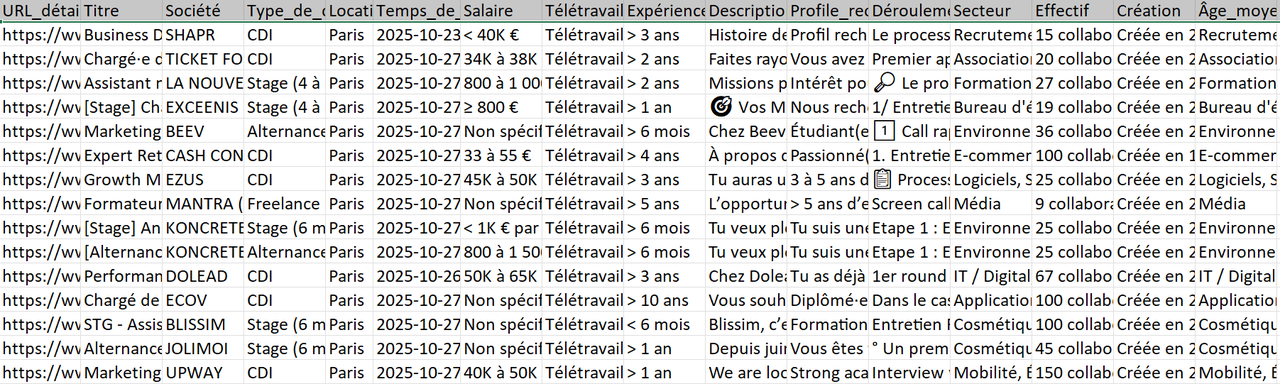

Voici les données récupérées avec le template Welcome to the Jungle d’Octoparse : titre du poste, entreprise, localisation, type de contrat, date de publication, lien vers l’offre. Un fichier Excel structuré, prêt à filtrer ou à intégrer dans un CRM.

3 fonctionnalités à connaître pour aller plus loin

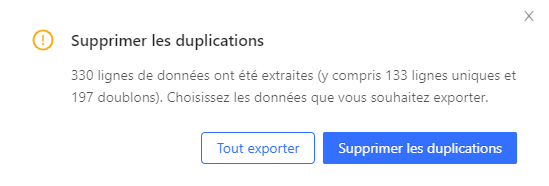

Déduplication automatique

Octoparse intègre une fonction de déduplication qui nettoie les doublons avant export. Vos données arrivent propres dans Excel, sans post-traitement.

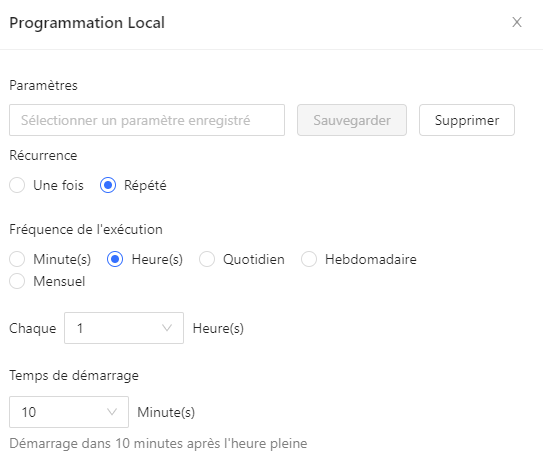

Planification des extractions

Les extractions peuvent être programmées (quotidienne, hebdomadaire, mensuelle) et s’exécutent en arrière-plan sur le cloud. Le fichier Excel mis à jour est disponible à l’heure choisie, sans intervention.

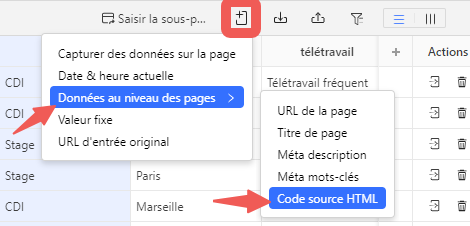

Extraction du code source HTML

Pour les besoins techniques, Octoparse peut extraire l’URL complète, les balises méta et le HTML brut de chaque élément, utile pour les audits SEO ou les intégrations dans d’autres systèmes.

Transformer les sites web vers Excel, CSV, Google Sheets ou base de données.

Auto-détecter les sites Web et extraire les données sans aucun codage.

Scraper les sites populaires en quelques clics avec les modèles pré-construits.

Ne se trouver jamais bloqué grâce aux proxies IP et à l’API avancée.

Service Cloud pour programmer le scraping de données.

La vidéo ci-dessous montre l’ensemble du processus en temps réel : du collage de l’URL jusqu’à l’export Excel, avec l’interface réelle d’Octoparse.

📍 À lire aussi : Exporter les résultats de recherche de Google Maps vers Excel

Méthode 2 : collecter des données web vers Excel via Power Query

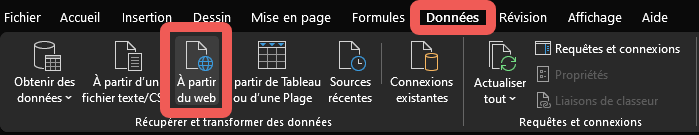

Excel propose une fonctionnalité native appelée Power Query, accessible depuis l’onglet Données, qui permet d’importer des données depuis des pages web directement dans un classeur.

Power Query ne peut importer que les tableaux HTML statiques présents dans le code source de la page. Il ne fonctionne pas avec les sites qui chargent leurs données via JavaScript (React, Vue.js, Angular), ce qui représente la très grande majorité des sites modernes : e-commerce, plateformes d’emploi, réseaux sociaux. Si la page affiche ses données après un chargement dynamique, Power Query retournera une erreur ou un tableau vide. Dans ce cas, passez directement à la méthode 1.

Étapes pour importer des données web dans Excel avec Power Query

- Ouvrir Excel et accéder à la fonctionnalité d’importation

Lancez Excel, puis allez dans l’onglet Données. Cliquez sur À partir du web (ou Obtenir des données > À partir du web).

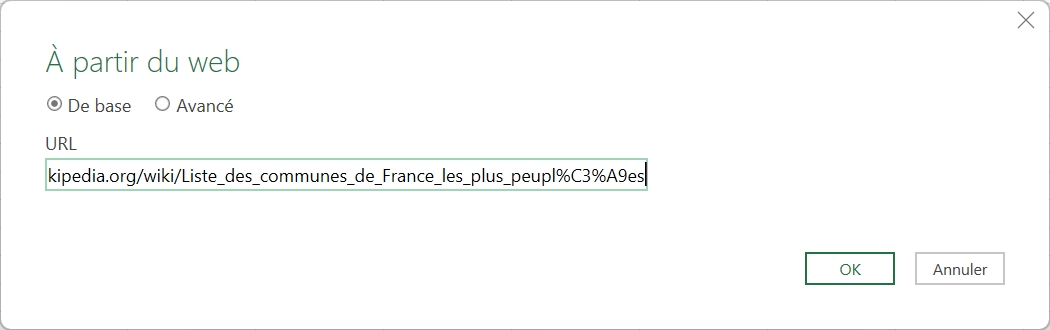

- Entrer l’URL de la page web

Dans la fenêtre qui s’ouvre, collez l’URL de la page contenant le tableau à importer.

Exemple concret : la page Wikipedia listant les communes françaises de plus de 30 000 habitants contient un tableau HTML statique directement importable par Power Query. Cliquez sur OK.

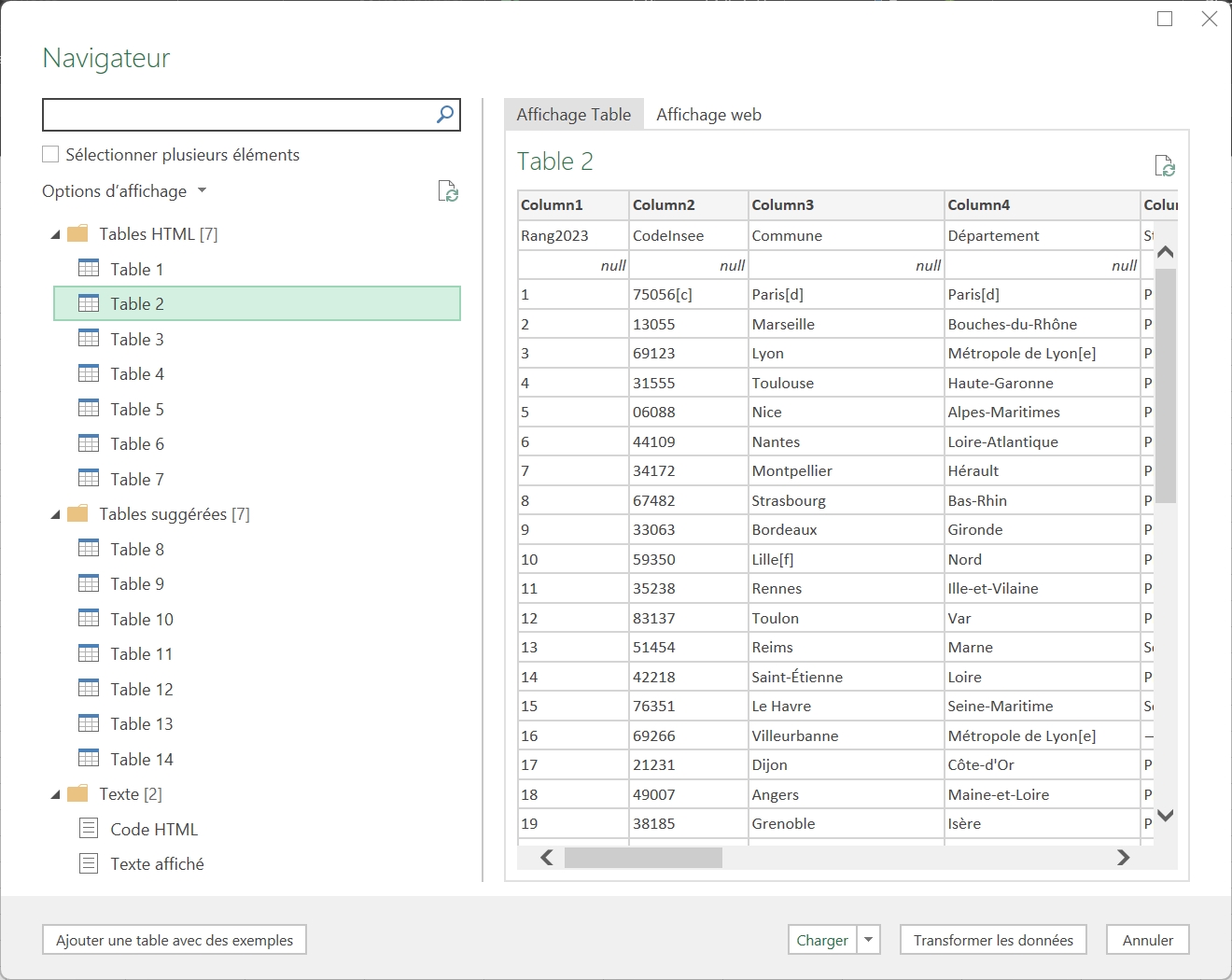

- Sélectionner les tables détectées

Excel affichera une liste de tables suggérées, qui sont des tableaux détectés automatiquement sur la page web. Choisissez la table qui vous intéresse, puis cliquez sur Charger ou Transformer.

- (Optionnel) Ajouter une table à l’aide d’exemples

Pour aller plus loin, vous pouvez utiliser la fonctionnalité “Ajouter une table à l’aide d’exemples“.

Il suffit d’indiquer quelques exemples de valeurs que vous souhaitez extraire (par exemple, le nom et le prix des jeux). Power Query utilisera des algorithmes intelligents pour reconnaître le modèle et extraire les données correspondantes.

- Finaliser l’importation

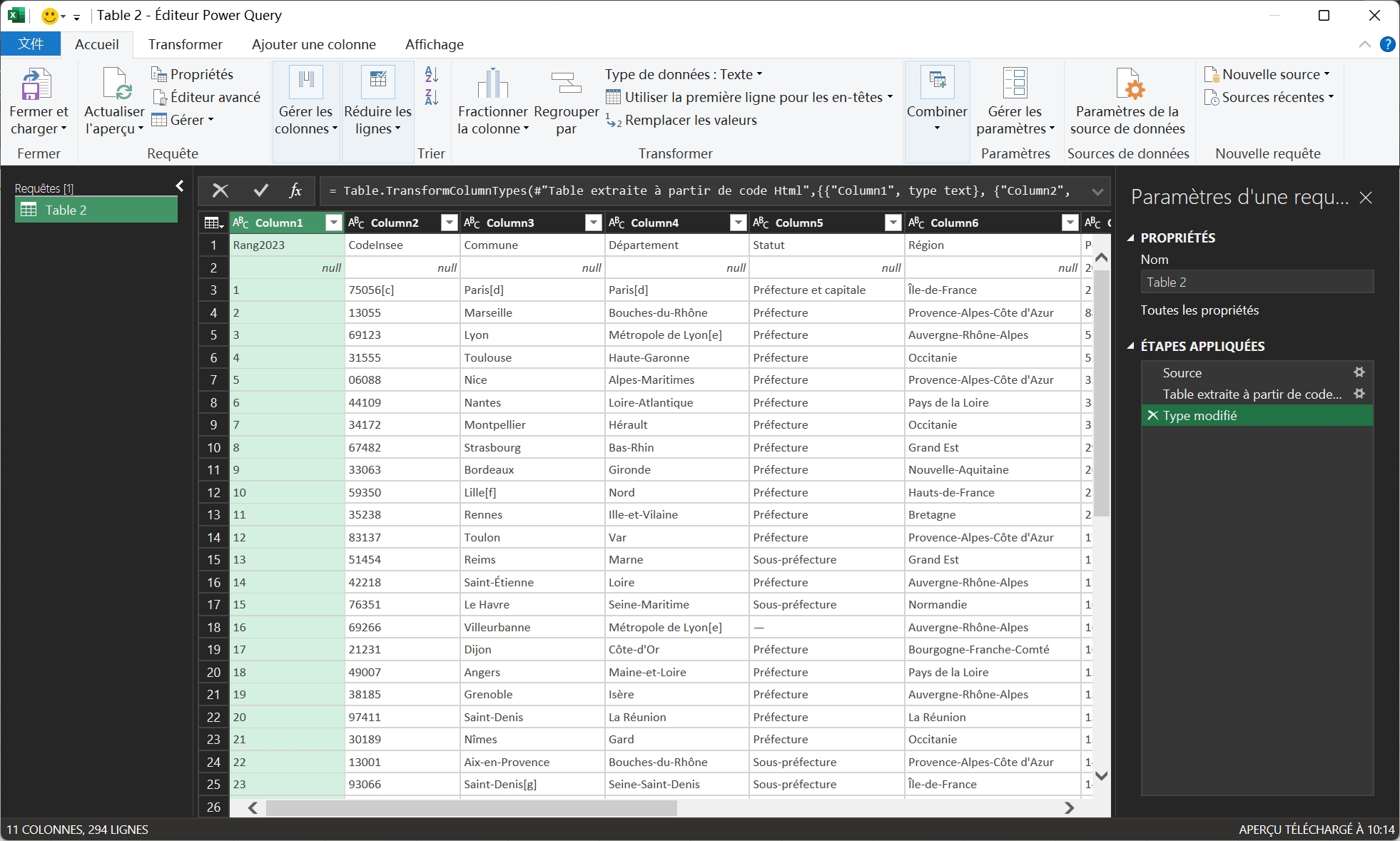

Une fois que les données extraites vous conviennent, cliquez sur OK pour charger la table dans Excel.

Vous pouvez ensuite utiliser l’Éditeur Power Query pour mettre en forme les données ou les charger directement dans la feuille.

Cas d’usage adaptés à Power Query en France

- Tableaux de statistiques officiels : INSEE, data.gouv.fr, Banque de France

- Cours boursiers depuis des pages de cotation avec tableaux HTML

- Classements publiés sur Wikipedia en français

- Données de sites institutionnels (collectivités, organismes publics)

Fonctions Excel utiles après l’import

RECHERCHEV / RECHERCHEX : fusionner deux sources de données. Exemple : rapprocher vos prix scrapés depuis Cdiscount avec votre catalogue interne pour calculer les écarts de marge.

SOMME.SI.ENS : agréger par critères. Exemple : total des salaires proposés par secteur d’activité dans vos offres d’emploi scrapées.

NB.SI / NB.SI.ENS : compter les occurrences. Exemple : nombre d’annonces Leboncoin par département pour un type de bien immobilier.

INDEX/EQUIV : alternative plus flexible à RECHERCHEV, particulièrement utile quand les colonnes source évoluent.

Conseil : après chaque import, commencez par Données > Supprimer les doublons, puis Tri, avant d’appliquer ces formules. Cette étape d’extraction de données Excel transforme vos données brutes en rapport exploitable en moins de 5 minutes.

Méthode 3 : extraire des données web vers Google Sheets avec IMPORTHTML

Si vous travaillez dans Google Workspace plutôt qu’avec Excel, deux fonctions intégrées permettent d’importer directement des données depuis des pages web, sans aucune installation.

IMPORTHTML : importer un tableau depuis une page web

La fonction =IMPORTHTML() récupère un tableau ou une liste depuis n’importe quelle page web accessible publiquement.

Syntaxe :

=IMPORTHTML(“URL”; “table” ou “list”; numéro_du_tableau)

Exemple concret (données françaises) :

=IMPORTHTML(“https://fr.wikipedia.org/wiki/Liste_des_communes_de_France_les_plus_peuplées”; “table”; 1)

Cette formule importe directement dans Google Sheets le tableau des communes françaises les plus peuplées depuis Wikipedia. Le résultat se met à jour automatiquement quand la page source change.

IMPORTDATA : importer un fichier CSV ou TSV depuis une URL

Pour les sources qui publient leurs données au format CSV (ce que font data.gouv.fr, l’INSEE ou Eurostat), utilisez =IMPORTDATA().

=IMPORTDATA(“https://www.data.gouv.fr/fr/datasets/r/votre-fichier.csv”)

Limites à connaître

- Comme Power Query, IMPORTHTML ne fonctionne que sur les tableaux HTML statiques. Les sites JavaScript dynamiques sont hors de portée.

- Google limite les requêtes automatiques : si votre feuille contient trop de fonctions IMPORT, certaines peuvent échouer temporairement.

- Les données importées sont en lecture seule dans la cellule ; pour les analyser, copiez-collez-les en valeurs dans une autre feuille.

Pour les sources françaises institutionnelles (data.gouv.fr, INSEE, Banque de France), Google Sheets avec IMPORTDATA est souvent la solution la plus simple et la plus fiable, car ces organismes publient directement leurs jeux de données au format CSV téléchargeable.

Méthode 4 : extraire des données web avec VBA dans Excel

VBA (Visual Basic for Applications) permet d’automatiser l’extraction via des macros directement dans Excel. C’est la solution la plus flexible pour les utilisateurs à l’aise avec la programmation Office, sur Windows uniquement.

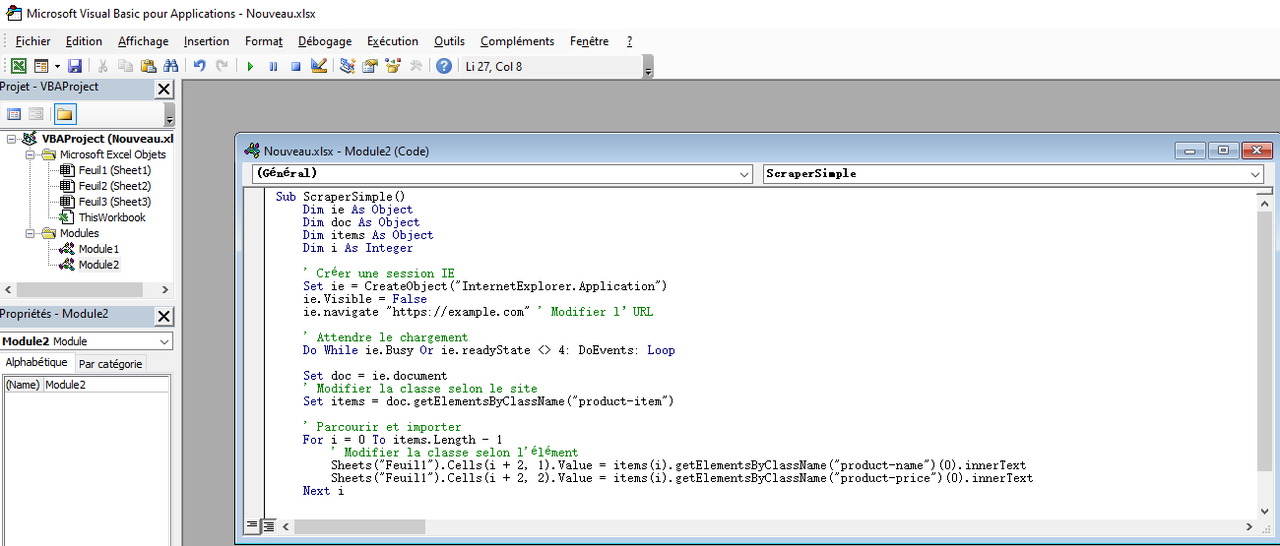

Les tutoriels VBA publiés avant 2022 utilisent Internet Explorer (CreateObject(“InternetExplorer.Application”)). Internet Explorer a été officiellement arrêté par Microsoft en juin 2022 et n’existe plus sur Windows 11. Tout code basé sur IE échouera. Le script ci-dessous utilise XMLHttpRequest, qui fonctionne sur toutes les versions actuelles de Windows.

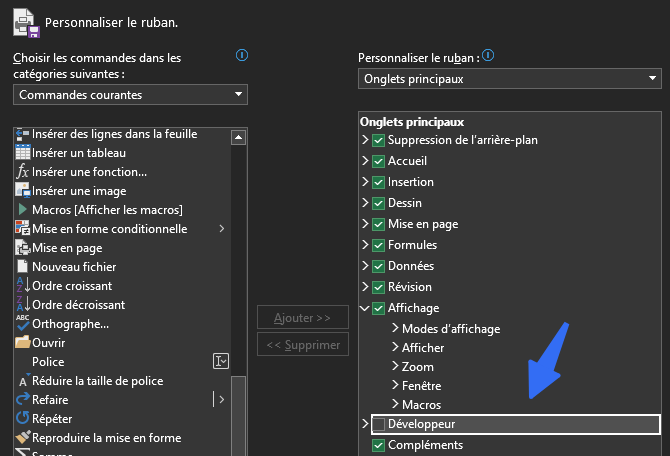

Préparation : activer l’onglet Développeur

Fichier > Options > Personnaliser le ruban > cochez “Développeur” dans la colonne de droite, puis validez.

Étape 1 : Ouvrir l’éditeur VBA et insérer un module

1. Cliquez sur Développeur > Visual Basic pour ouvrir l’éditeur

2. Allez dans Insertion > Module

Étape 2 : Coller le script et l’exécuter

Copiez-collez le code ci-dessous dans le module, adaptez l’URL cible, puis appuyez sur F5 pour lancer.

Code VBA moderne avec XMLHttpRequest

Ce script extrait les données d’une page web dont le contenu est disponible dans le HTML source (sites statiques). Pour les sites JavaScript dynamiques, utilisez la méthode 1.

Comment personnaliser ce script :

- Remplacez https://votre-url-cible.fr par l’URL de votre page source

- getElementsByTagName(“table”)(0) cible le premier tableau ; passez à (1) pour le deuxième, etc.

- Adaptez le nom de la feuille si elle ne s’appelle pas Feuil1

- Appuyez sur F5 dans l’éditeur VBA pour exécuter, ou associez le script à un bouton

Limites du VBA pour l’extraction web

- Ne fonctionne pas sur les sites qui chargent leur contenu via JavaScript (la grande majorité des sites modernes)

- Maintenance nécessaire si la structure HTML de la page source change

- Windows uniquement : VBA n’est pas disponible sur Excel Mac pour l’extraction web

- Pour les volumes importants ou les sites complexes, la méthode 1 (outil no-code) reste plus fiable

Visualiser les données extraites

Graphiques croisés dynamiques

Insertion > Tableau croisé dynamique : glissez vos champs pour calculer des moyennes, totaux ou comptages automatiquement. Exemple : nombre d’offres d’emploi par secteur et par région depuis vos données scrapées.

Mise en forme conditionnelle

Accueil > Mise en forme conditionnelle > Barres de données : visualisez d’un coup d’oeil les valeurs les plus hautes ou les plus basses (prix minimum concurrent, salaire médian par ville).

Astuce

Ctrl+T transforme votre plage de données en Tableau structuré. Vos graphiques se mettent alors à jour automatiquement à chaque nouvelle extraction, sans manipulation supplémentaire.

Méthode 5 : externaliser la collecte de données web

Quand le volume de données est important, que les sites cibles sont complexes, ou que l’équipe n’a pas les ressources pour gérer l’infrastructure de scraping en interne, faire appel à un service spécialisé est souvent plus rentable.

Octoparse propose un service de données sur mesure : vous définissez vos besoins (sources, champs, fréquence, format), l’équipe prend en charge l’extraction et vous livre les données structurées directement en Excel, CSV ou dans votre base de données.

Pour toute demande, contactez : support@octoparse.com

Web scraping et RGPD : ce qu’il faut savoir en France

La France est l’un des pays européens où le RGPD est appliqué avec le plus de rigueur, via la CNIL. Avant de scraper un site, voici les règles essentielles :

- Données publiques non personnelles : la collecte est généralement légale. Prix de produits, annonces immobilières, résultats de recherche, informations d’entreprises publiées publiquement.

- Données personnelles : nom, email, numéro de téléphone d’un particulier sont protégés par le RGPD, même s’ils sont accessibles publiquement en ligne. Leur collecte automatisée sans base légale est interdite.

- Conditions d’utilisation du site : certains sites interdisent explicitement le scraping dans leurs CGU. Même si le contenu est public, enfreindre les CGU peut entraîner des poursuites judiciaires.

- robots.txt : respectez les directives de ce fichier, qui indique les pages qu’un site autorise ou interdit aux robots.

Pour les besoins professionnels de génération de leads B2B, les informations d’entreprises (raison sociale, téléphone professionnel, adresse du siège) sont considérées comme des données publiques et restent dans le cadre légal. Les informations personnelles des dirigeants (email personnel, téléphone personnel) en revanche ne le sont pas.

En résumé : quelle méthode choisir ?

Le choix de la méthode dépend de trois critères : votre niveau technique, le type de site cible, et le volume de données à traiter.

| Situation | Méthode recommandée |

| Site statique avec tableau HTML, usage ponctuel | Power Query (Excel) ou IMPORTHTML (Google Sheets) |

| Source officielle française (INSEE, data.gouv.fr) | IMPORTDATA dans Google Sheets |

| Site JavaScript dynamique, e-commerce, emploi, immobilier | Outil no-code : Octoparse ou équivalent |

| Sites français populaires (Leboncoin, WTTJ, PagesJaunes) | Templates Octoparse prêts à l’emploi |

| Automatisation récurrente, volume important | Outil no-code avec planification cloud |

| Développeur, besoin sur mesure, site statique | VBA avec XMLHttpRequest (Windows uniquement) |

| Données complexes, délégation complète | Service de données Octoparse |

Besoin de récupérer des données depuis Leboncoin, Welcome to the Jungle, SeLoger ou un site e-commerce français vers Excel, sans écrire une ligne de code ? Avec les templates Octoparse dédiés au marché français, vous saisissez vos paramètres de recherche et vous obtenez en quelques minutes un fichier structuré avec les champs qui vous intéressent : noms, prix, adresses, contacts, prêt à exploiter dans Excel ou Google Sheets. L’essai gratuit de 14 jours vous permet de tester l’ensemble des fonctionnalités avant de vous engager.

FAQ

- Comment puis-je extraire des données d’un site web dans Excel ?

Trois méthodes principales : Power Query (onglet Données > À partir du web) pour les tableaux HTML statiques, un outil no-code comme Octoparse pour les sites dynamiques et les volumes importants, ou VBA avec XMLHttpRequest pour les développeurs. Si le site utilise JavaScript pour afficher ses données, seul un outil de scraping dédié fonctionnera.

- Comment importer des données web vers Excel ?

Depuis Excel : onglet Données > À partir du web > collez l’URL > sélectionnez le tableau > Charger. Cette méthode fonctionne uniquement sur les sites avec des tableaux HTML statiques. Pour les sites dynamiques (la majorité des sites modernes), utilisez un outil de web scraping.

- Comment extraire toutes les données d’un site web ?

Pour extraire l’intégralité des données d’un site (plusieurs pages, pagination, sous-pages), il faut un outil capable de suivre la navigation automatiquement. Octoparse gère la pagination, les liens vers les pages de détail et le défilement infini. Power Query et VBA sont limités à une page à la fois.

- Comment extraire automatiquement des données d’un site web vers une feuille de calcul ?

Avec Octoparse, vous pouvez planifier des extractions automatiques (quotidiennes, hebdomadaires) qui s’exécutent sur le cloud. Le fichier Excel mis à jour est disponible à l’heure choisie. Avec Google Sheets et IMPORTHTML, les données se rafraîchissent automatiquement quand la page source change.

- Puis-je utiliser directement Excel pour extraire des données d’un site web ?

Oui, via Power Query (onglet Données > À partir du web). Mais cette méthode est limitée aux tableaux HTML statiques. Elle ne fonctionne pas sur les sites qui chargent leurs données via JavaScript, ce qui exclut la plupart des sites d’e-commerce, d’emploi et d’immobilier.

- Le code VBA que j’ai trouvé sur internet ne fonctionne pas, pourquoi ?

La majorité des tutoriels VBA pour le web scraping utilisent Internet Explorer (CreateObject(“InternetExplorer.Application”)). IE a été arrêté par Microsoft en juin 2022 et n’existe plus sur Windows 11. Utilisez le code basé sur XMLHttpRequest présenté dans cet article, qui fonctionne sur toutes les versions actuelles de Windows.

- Est-ce légal d’extraire des données depuis des sites web en France ?

La collecte de données publiques non personnelles est généralement légale. En France, le RGPD encadre strictement la collecte de données personnelles (nom, email, téléphone d’un particulier). Respectez toujours le fichier robots.txt du site et ses conditions d’utilisation. En cas de doute, consultez un professionnel du droit.

- Comment extraire des données HTML vers Excel ?

Si le tableau est directement visible dans le code source de la page (HTML statique), Power Query ou VBA suffisent. Si les données sont chargées dynamiquement via JavaScript, utilisez un outil de scraping no-code qui simule la navigation dans un vrai navigateur.