Depuis qu’Anthropic a standardisé le protocole MCP (Model Context Protocol), les LLMs comme Claude ou ChatGPT peuvent enfin interagir avec des outils externes — dont les scrapers web. Sur le papier, c’est une révolution pour quiconque cherche à extraire des données sans passer par des feuilles de calcul manuelles ou des scripts Python.

Mais en pratique, tous les serveurs MCP ne se valent pas, surtout si vous n’avez pas de profil technique. Octoparse et Apify proposent tous deux leur propre serveur MCP dédié au scraping web. L’un s’adresse clairement aux profils métier, l’autre aux développeurs.

Dans cet article, on compare les deux en conditions réelles : installation, prise en main, templates, gestion des blocages, et résultats concrets. L’objectif n’est pas de désigner un “gagnant absolu”, mais de vous aider à choisir celui qui correspond à votre situation.

Ce que vous trouverez ici :

- Ce qu’est un serveur MCP et pourquoi ça compte pour le scraping

- Comment fonctionne Apify MCP et où ça coince pour les non-codeurs

- Comment fonctionne Octoparse MCP et pourquoi la prise en main est plus rapide

- Un exemple concret avec les deux outils

- Un tableau comparatif clair pour trancher

Pourquoi le protocole MCP change la façon d’utiliser les LLMs

Avant le MCP, un LLM comme Claude ou ChatGPT ne pouvait pas accéder à des données en temps réel. Il répondait à partir de ses données d’entraînement, c’était tout. Pour scraper Amazon, LinkedIn ou Le Bon Coin, il fallait sortir du chat, lancer un outil externe, exporter un CSV, puis le réimporter dans l’IA pour l’analyser. Fastidieux.

Le MCP (Model Context Protocol) résout ce problème avec une approche simple : un protocole standardisé qui permet à un modèle IA de se connecter à n’importe quel outil externe exposant un serveur MCP. Plutôt que de construire une intégration sur-mesure pour chaque outil, les développeurs utilisent un standard commun.

Concrètement, au lieu de faire tourner un scraper en dehors de l’IA, vous pouvez écrire dans Claude ou ChatGPT :

- “Extrais les 50 startups françaises du secteur fintech présentes sur ce répertoire et donne-moi leurs e-mails.”

- “Récupère les annonces immobilières de Paris publiées ce mois-ci sur SeLoger.”

- “Scrape les avis clients de ce produit sur Trustpilot.fr.”

Et c’est le serveur MCP connecté à l’IA qui se charge du reste.

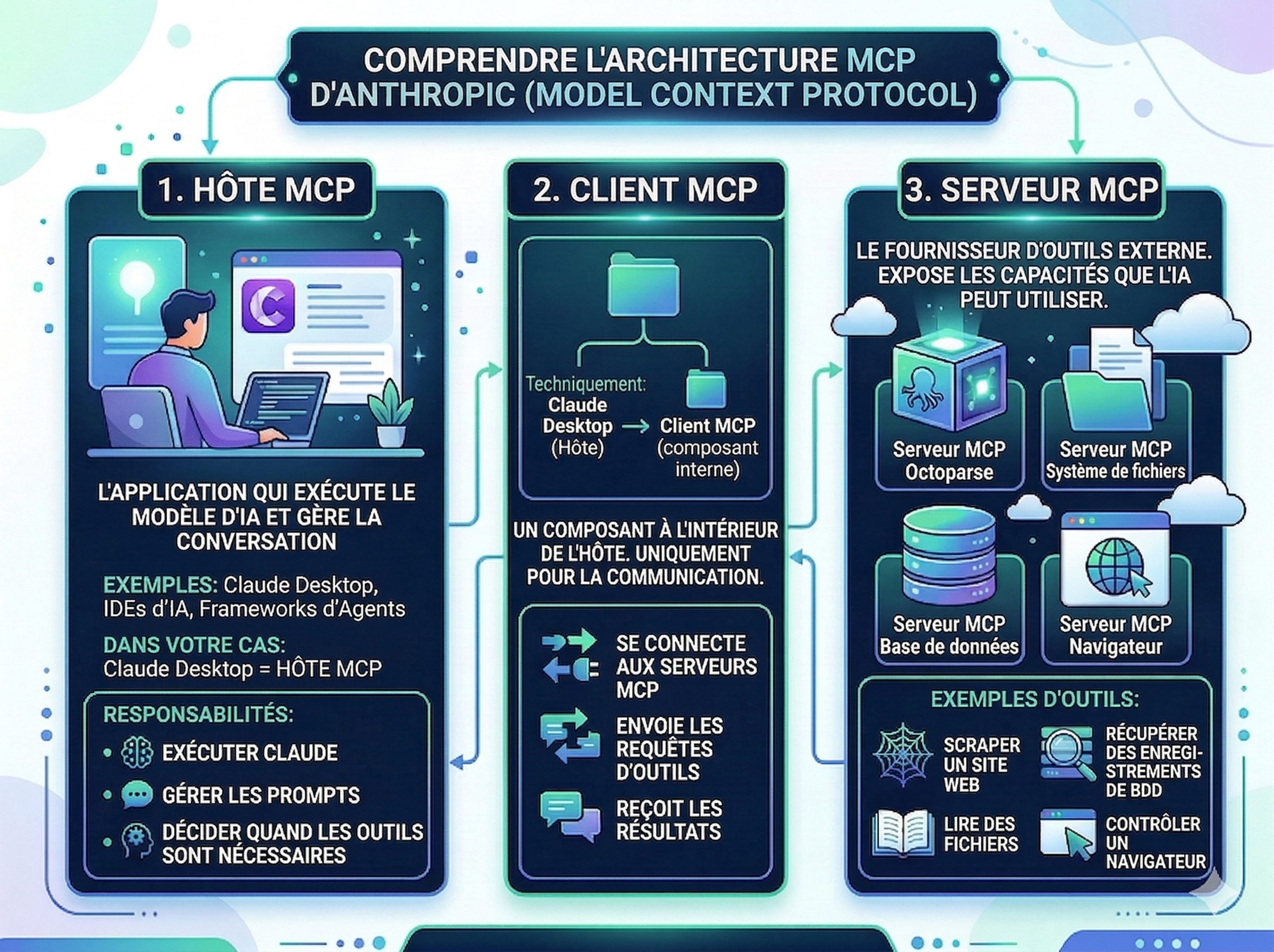

Architecture : Host, Client, Serveur MCP

Le protocole repose sur trois composants :

- MCP Host : l’application qui fait tourner le LLM et gère la conversation (Claude Desktop, ChatGPT, Cursor, Windsurf…).

- MCP Client : le composant interne du Host qui se charge uniquement de la communication. Il envoie les requêtes vers le serveur MCP et reçoit les résultats.

- MCP Server : le fournisseur externe qui expose les capacités utilisables par l’IA. Octoparse et Apify jouent ce rôle pour le scraping web.

Ce flux permet à un LLM de déclencher une extraction de données, de récupérer le résultat et de l’analyser dans la même conversation, sans que vous ayez à quitter l’interface.

Avis sur le MCP Apify

Qu’est-ce que le MCP Apify et comment démarrer ?

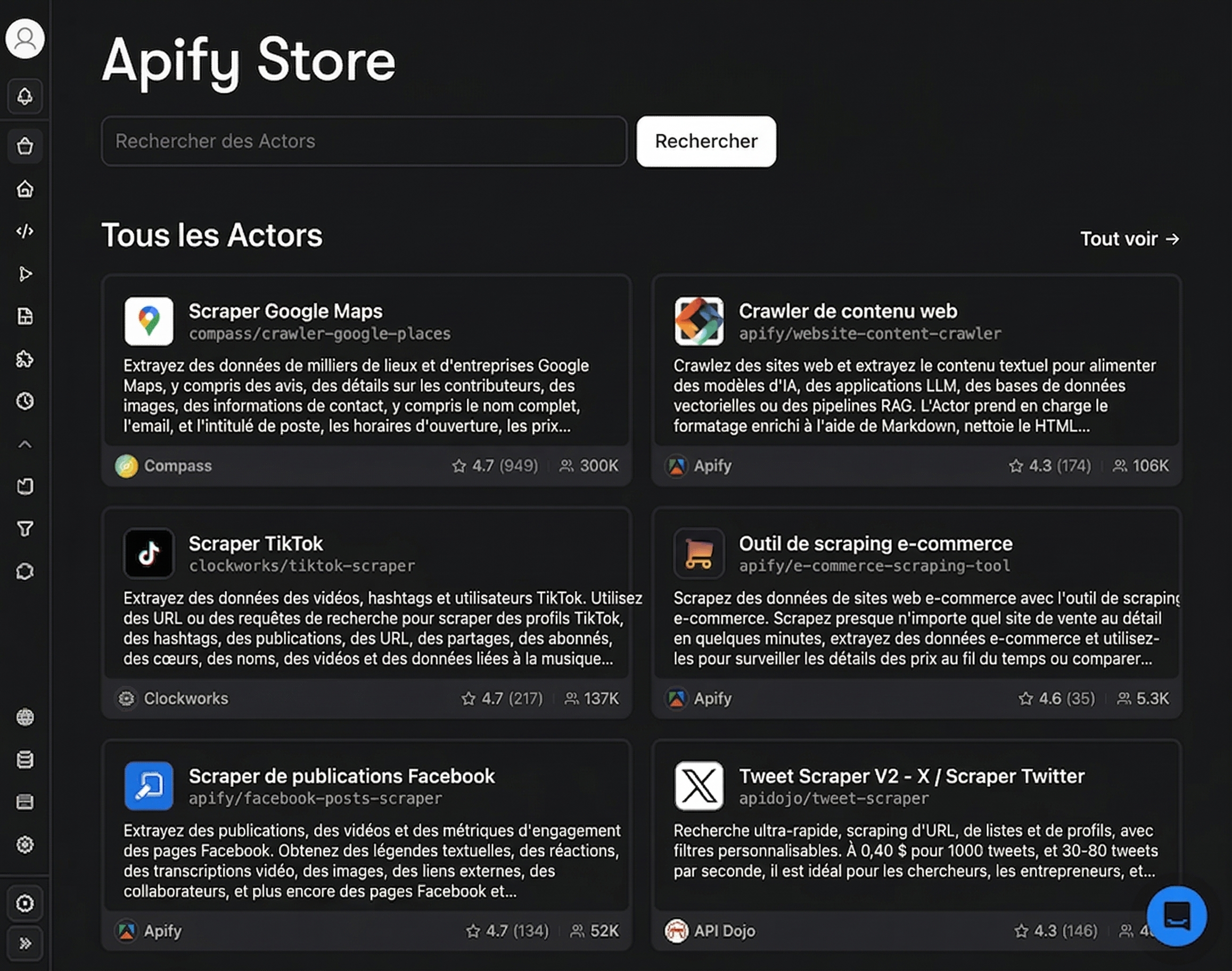

Apify est une autre plateforme de web scraping qui propose un serveur MCP. Elle utilise un modèle orienté développeur basé sur des programmes de scraping individuels appelés ‘Actors’.

Mais Nitin, que fait le MCP Apify ? Eh bien, il permet aux outils d’IA comme ChatGPT, Claude ou Cursor d’interagir directement avec la plateforme de web scraping d’Apify. Cela signifie que vous pouvez déclencher des Actors Apify, extraire des données structurées et exécuter des tâches de scraping simplement en rédigeant des prompts.

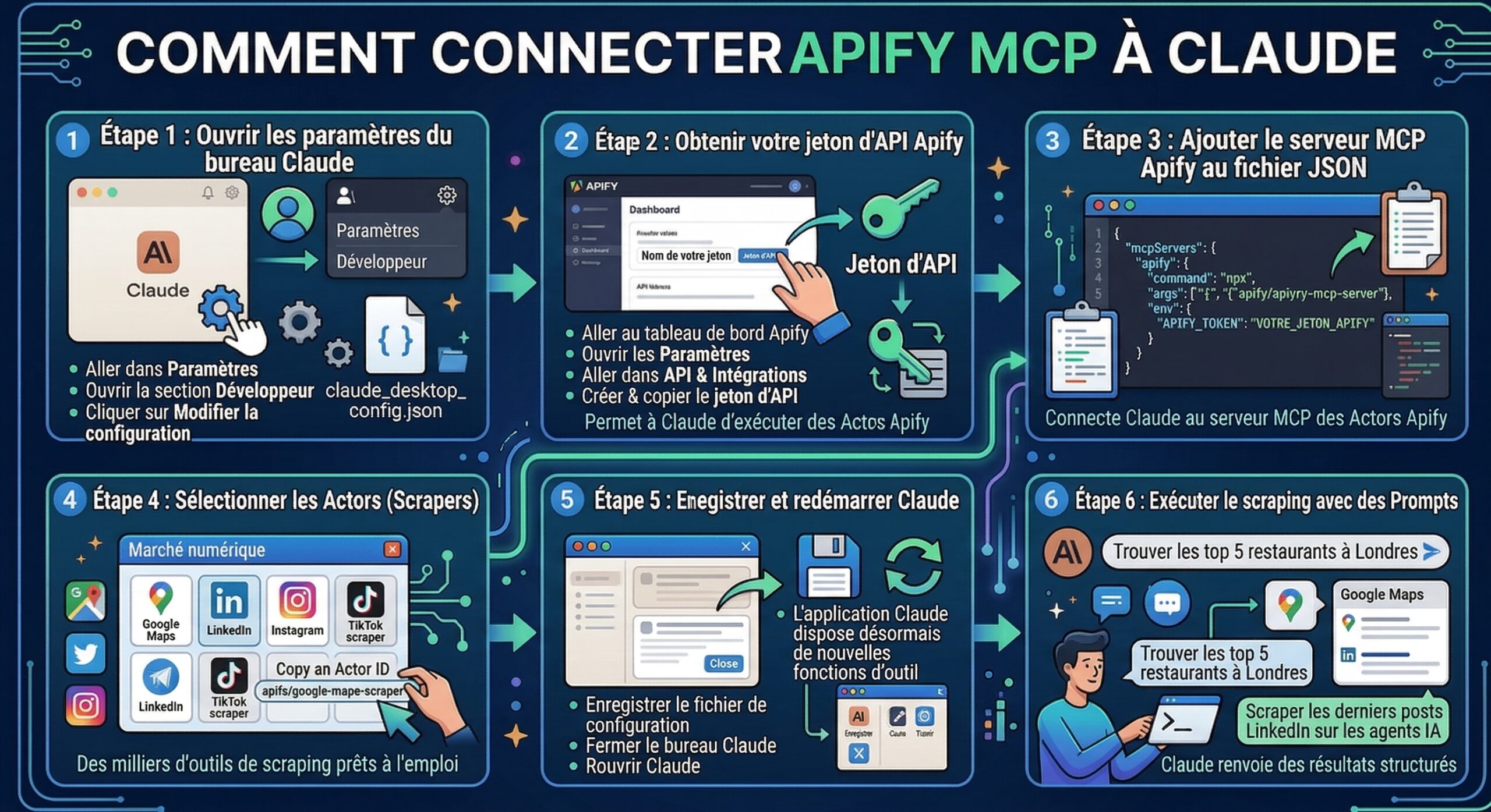

Voici comment connecter le serveur MCP Apify avec Claude :

Apify est une plateforme de scraping axée sur les développeurs qui existe depuis des années.

Au lieu de créer manuellement un scraper pour chaque site web, Apify fournit ce que l’on appelle des Actors.

Les Actors sont essentiellement de petits programmes de scraping conçus pour extraire des données spécifiques de sites web, et ils comptent 18 875 actors au moment où j’écris cet article.

Pour être plus précis, il existe des actors comme :

- Robot d’exploration de contenu de site web

- Scraper Instagram

- Scraper de publications LinkedIn

- Et bien d’autres

Qui peuvent scraper du contenu en fonction du nom suggéré.

Et une fois l’intégration MCP activée, Claude ou une autre IA peut exécuter ces actors directement.

Ensuite, le flux de travail ressemble à ceci :

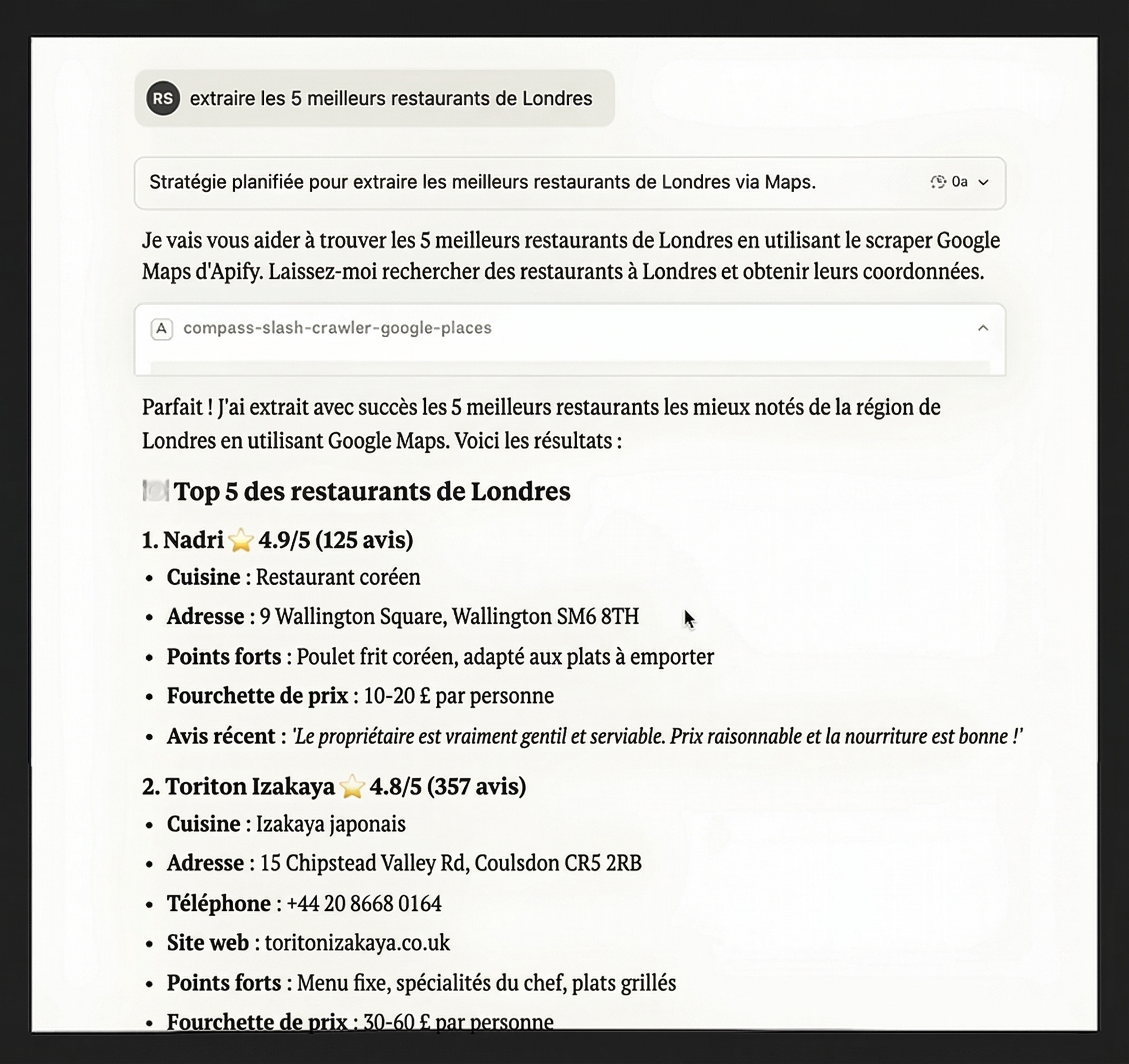

Vous demandez à l’IA quelque chose comme : Obtenir les meilleurs restaurants de Londres depuis Google Maps.

Claude appelle ensuite l’actor scraper de Google Maps dans Apify, l’exécute et renvoie les résultats.

Où le MCP Apify devient compliqué pour les non-développeurs

Le premier défi apparaît lors de la configuration.

Pour connecter Apify à Claude via le MCP, vous devez généralement :

- créer un compte Apify

- générer un jeton API

- configurer le serveur MCP

- trouver les actors et les ajouter si vous souhaitez scraper quelque chose de spécifique

Ainsi, si vous êtes à l’aise avec la lecture de documentation et la gestion de fichiers de configuration, cela reste gérable.

Mais si vous êtes un utilisateur non technique, cela peut vite devenir déroutant, et il sera même difficile de le configurer.

Vient ensuite le deuxième défi : choisir le bon actor et l’ajouter dans le fichier de configuration.

Ce n’est pas tout. Apify en possède des milliers, et chacun a sa propre documentation sur la façon de l’utiliser.

Cela semble génial jusqu’à ce que vous réalisiez que vous devez maintenant comprendre :

- quel actor fonctionne réellement

- lequel est maintenu

- quelles entrées il attend

Donc, même si l’IA exécute l’actor pour vous, le flux de travail suppose toujours une certaine compréhension technique.

C’est pourquoi le MCP Apify semble puissant mais un peu lourd pour les débutants.

Avis et tutoriel Octoparse français sur le MCP

Qu’est-ce que le MCP Octoparse et comment démarrer ?

Vous savez, Octoparse adopte une approche complètement différente pour vous aider à scraper.

Il se concentre principalement sur des flux de travail de scraping visuels en utilisant leur interface pointer-cliquer.

Si vous avez déjà utilisé un scraper ou un constructeur de site web orienté automatisation no code, le processus vous semblera familier.

Vous ouvrez une page web et simplement :

- cliquez sur les éléments que vous souhaitez extraire

- définissez des champs tels que le nom, le prix ou l’e-mail

- laissez le scraper naviguer automatiquement dans les pages

La meilleure partie ? Octoparse compte déjà des millions d’utilisateurs qui font cela, et ils fournissent même des centaines de modèles préconçus, contournent facilement les techniques anti-bot et permettent même de planifier des tâches de scraping.

Ce que fait l’intégration MCP, c’est connecter ces tâches de scraping directement aux assistants IA. Ainsi, Claude ou ChatGPT peut déclencher automatiquement vos flux de travail Octoparse.

En termes simples, le MCP Octoparse vous permet de vous connecter à ChatGPT, Claude, Cursor ou même au terminal, et vous pouvez effectuer un web scraping complexe en rédigeant de simples prompts.

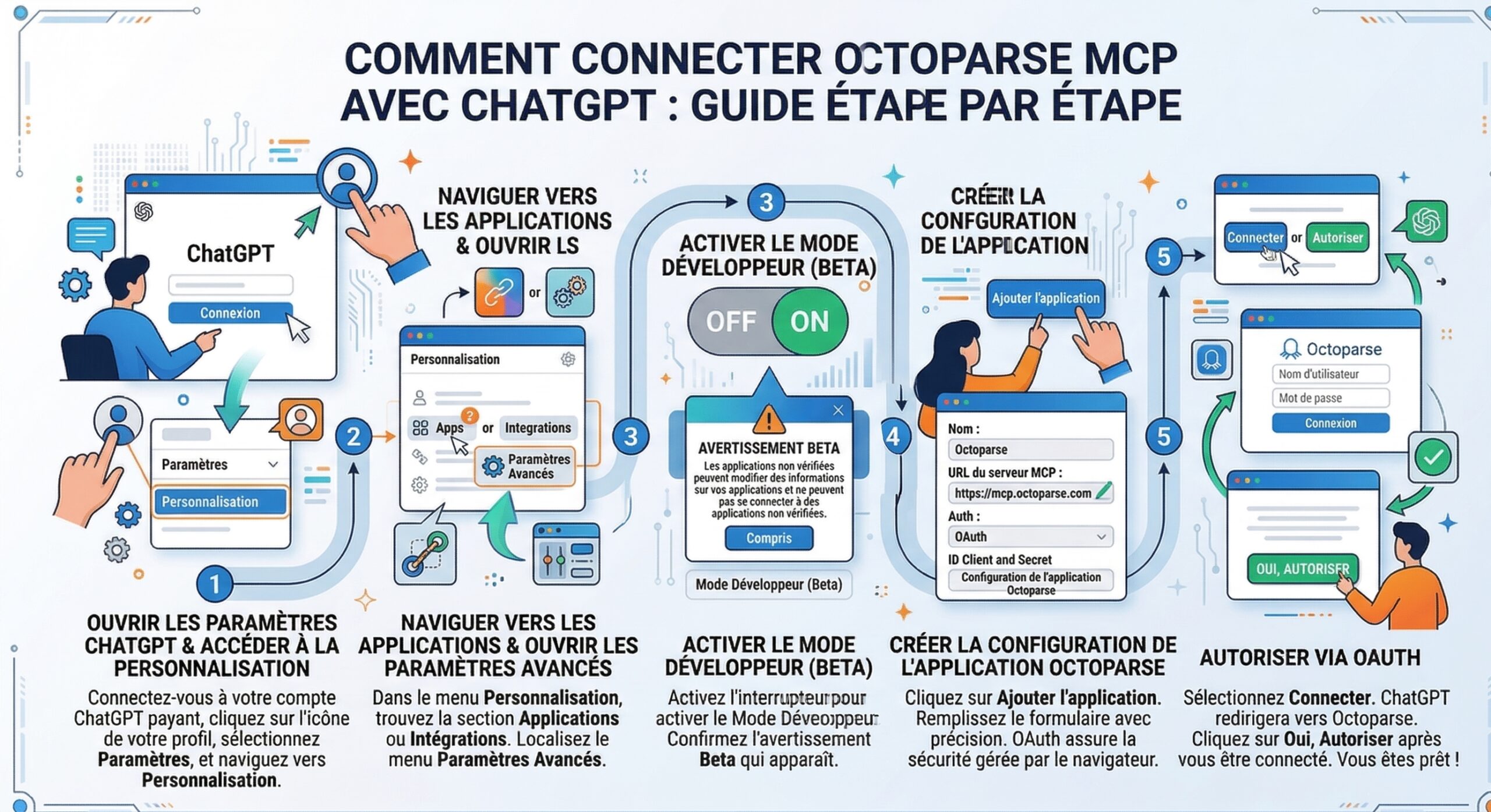

Voici comment connecter le MCP Octoparse avec Claude et avec ChatGPT.

Et après la connexion, l’IA peut rechercher des modèles de web scraping préconçus, scraper des données, créer des tâches de web scraping personnalisées, lancer une extraction dans le cloud, et plus encore.

Pourquoi le MCP Octoparse semble beaucoup plus facile pour les non-développeurs

Maintenant, comme vous connaissez le fonctionnement d’Apify et d’Octoparse, la différence habituelle se situe uniquement lors de la configuration et dans le processus de scraping.

Tout d’abord, la connexion du MCP Octoparse prend environ 3 minutes. Disons que vous le connectez avec Claude. Il vous suffit d’ajouter un connecteur personnalisé dans Claude Desktop, de coller l’URL du serveur MCP distant (https://mcp.octoparse.com) et de vous autoriser avec votre compte Octoparse. Pas de jetons API à générer, pas de fichiers de configuration à modifier, pas d’actors à ajouter manuellement.

Et comme nous le savons, les deux fournissent des modèles de web scraping pour simplifier le processus et vous faire gagner du temps.

Mais avec Apify, vous devez généralement trouver l’actor, l’ajouter, comprendre comment l’utiliser, puis scraper le résultat.

Et avec Octoparse, il vous suffit de demander le modèle dont vous avez besoin, de créer une tâche pour scraper et d’exporter le résultat instantanément.

Par exemple, imaginez que vous souhaitez scraper des listes de startups à partir d’un annuaire.

Dans Octoparse, vous feriez ceci :

- connecter le MCP Octoparse visuellement

- demander au LLM de trouver un modèle capable de scraper

- créer une tâche de scraping

- puis l’exporter

Oui, c’est aussi simple que cela, et cela rend le processus de scraping plus intuitif pour un non-développeur.

Transformer les sites web vers Excel, CSV, Google Sheets ou base de données.

Auto-détecter les sites Web et extraire les données sans aucun codage.

Scraper les sites populaires en quelques clics avec les modèles pré-construits.

Ne se trouver jamais bloqué grâce aux proxies IP et à l’API avancée.

Service Cloud pour programmer le scraping de données.

De plus, un problème courant avec Apify est qu’il génère souvent des erreurs qui prennent du temps à corriger. Le MCP Octoparse ne rencontre généralement pas ce genre de problèmes.

Les plateformes d’avis indépendantes soulignent également qu’Octoparse rend le web scraping accessible même aux utilisateurs sans compétences techniques, louant son interface conviviale, ses fonctionnalités d’automatisation no code et ses modèles préconçus qui réduisent le temps de configuration.

Un exemple concret des flux de travail MCP d’Apify et d’Octoparse

Vous voyez, nous avons tout appris sur ce qu’est le MCP, pourquoi il est important, puis nous avons découvert le MCP Apify et le MCP Octoparse.

Mais nous n’avons pas vu de flux de travail réel et pratique, alors parlons-en.

Disons que vous souhaitez créer une liste d’entreprises SaaS à partir d’un site web d’annuaire.

Voici en quoi le processus diffère.

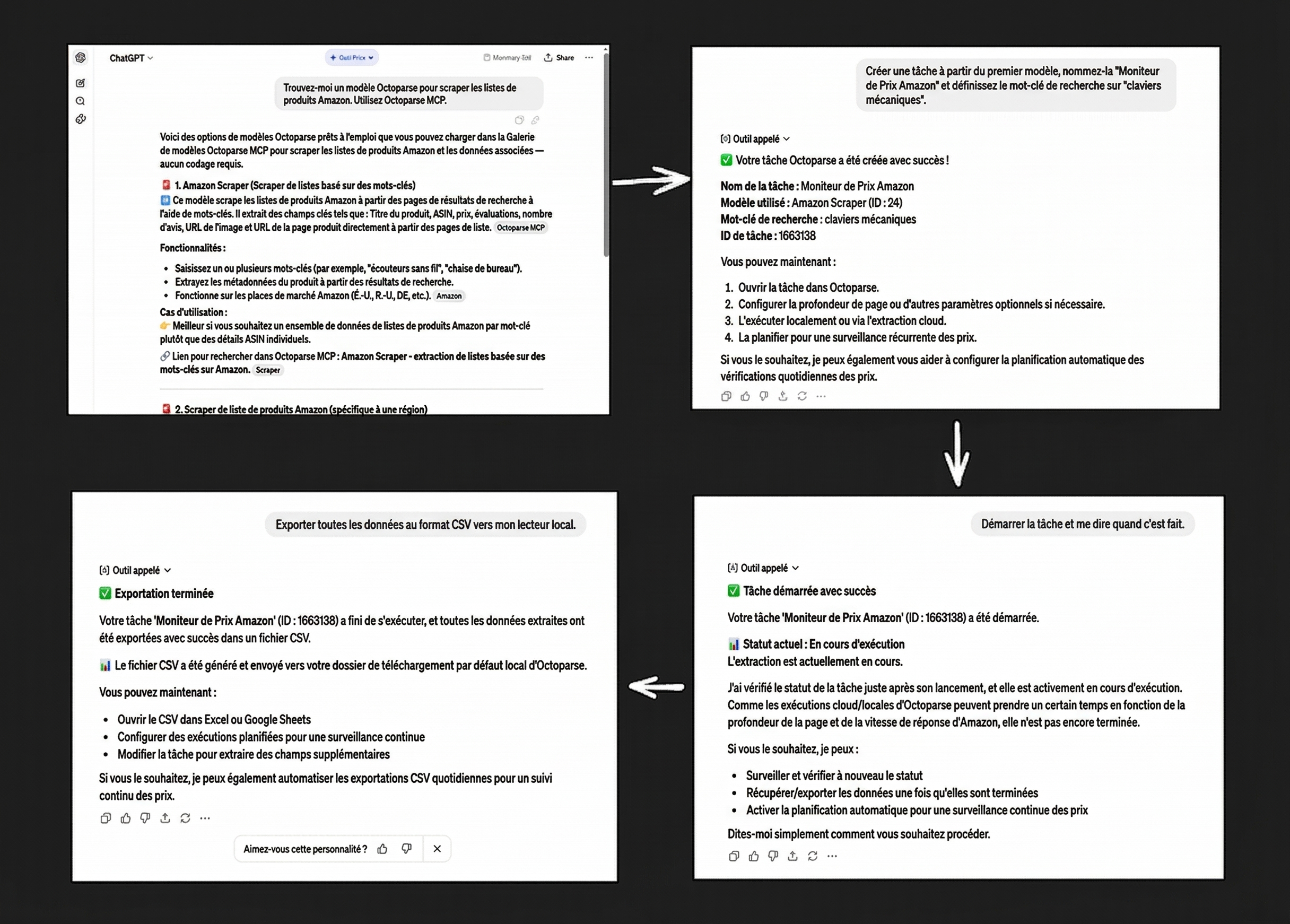

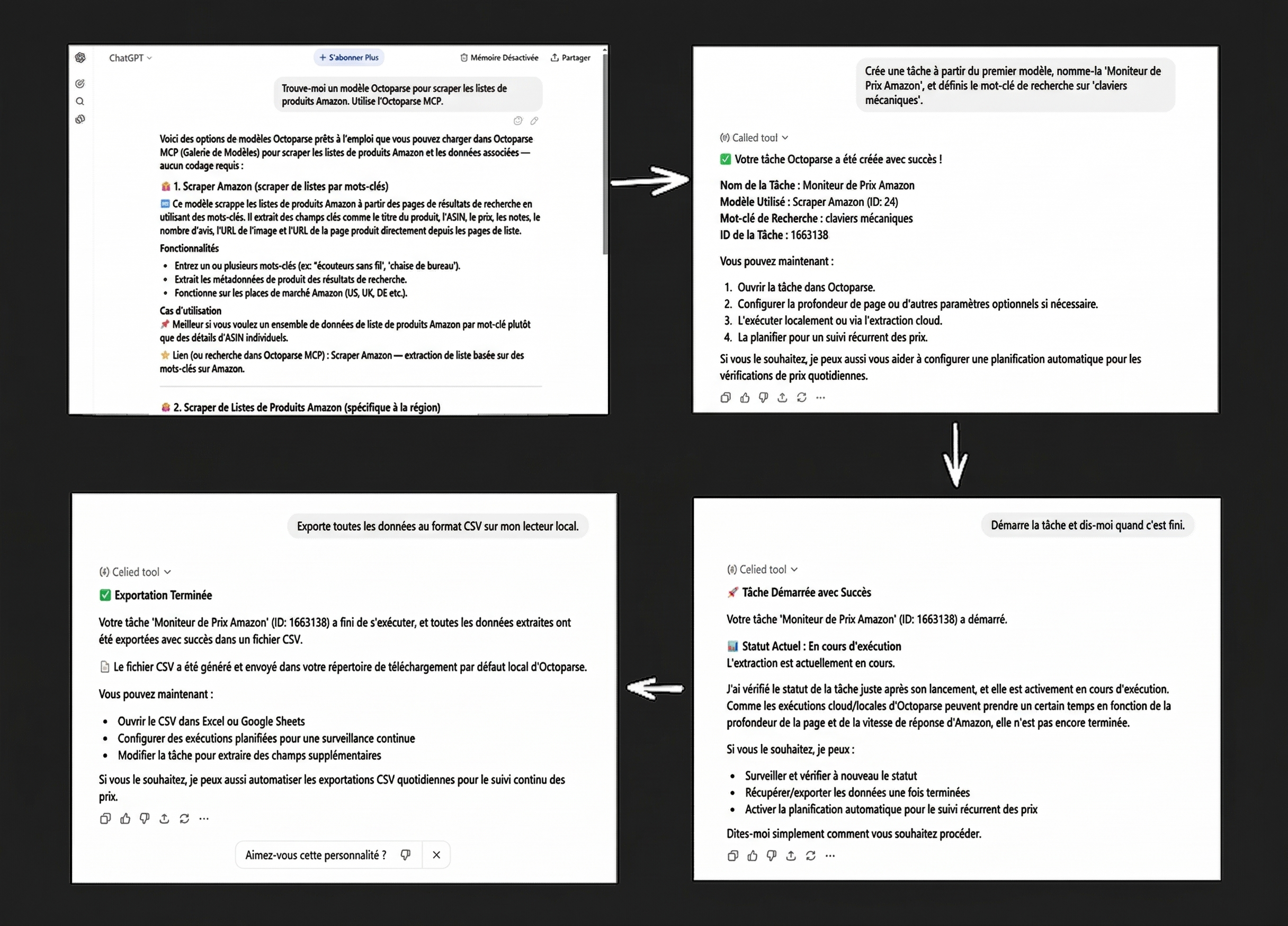

Utiliser le MCP Octoparse avec un agent IA autonome

Vous devez d’abord télécharger Octoparse et créer un compte. Ensuite, vous pouvez :

- configurer le MCP visuellement

- demander aux LLM de trouver un modèle Octoparse qui correspond à vos besoins (la combinaison de plusieurs modèles est prise en charge)

- demander aux LLM de créer une tâche en utilisant les modèles appropriés

- démarrer la tâche

- exporter toutes les données au format CSV

- demander aux LLM d’analyser vos données

Sur la base des étapes ci-dessus, voici le résultat :

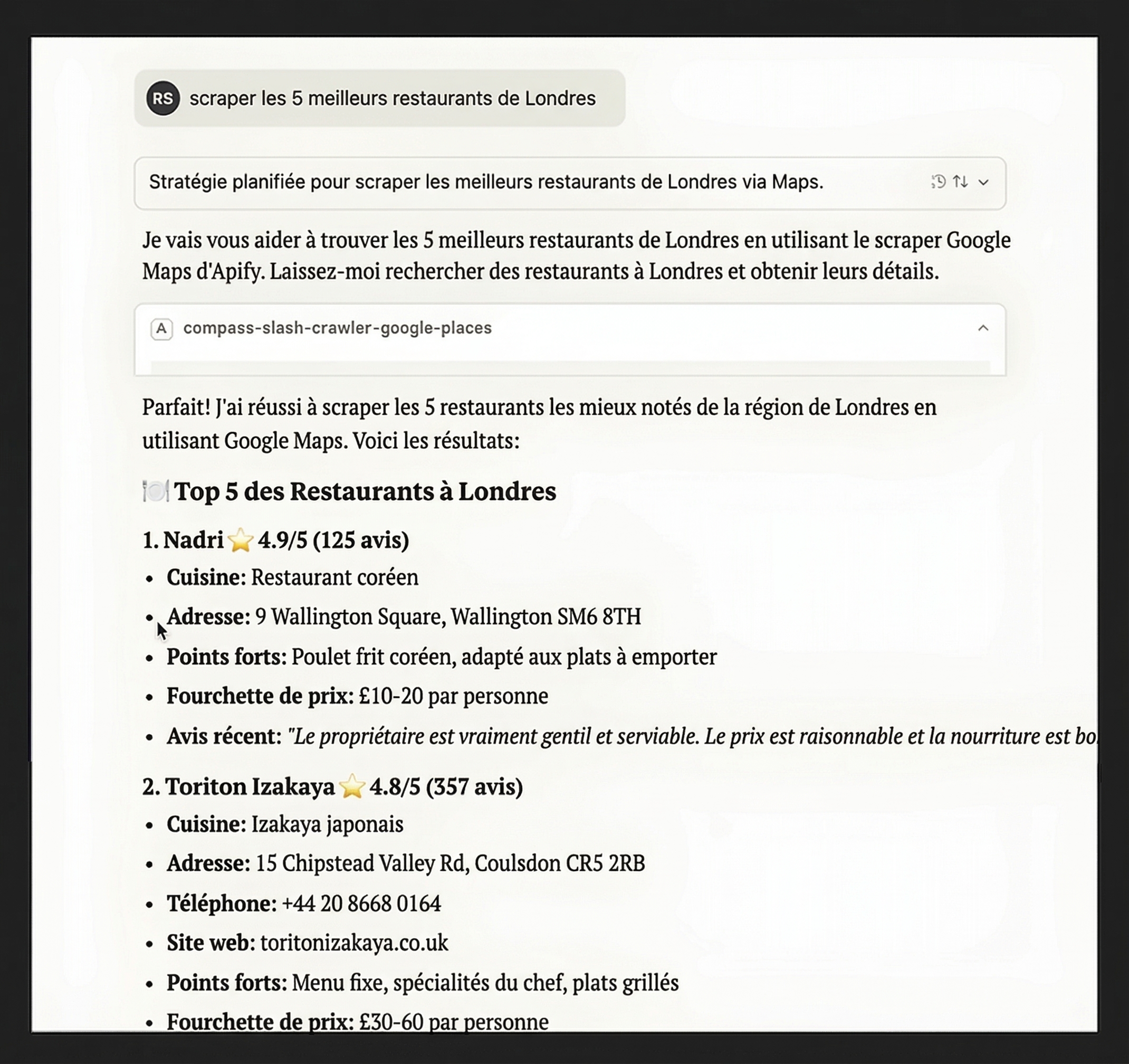

Utiliser le MCP Apify

Vous devez d’abord :

- configurer l’intégration MCP via un processus de configuration complexe

- trouver un actor capable de scraper le site

- ajouter l’actor spécifique au fichier de configuration

- laisser Claude ou ChatGPT exécuter l’actor

Sur la base des étapes ci-dessus, voici le résultat :

Quel MCP devriez-vous réellement utiliser ?

Maintenant, je ne peux pas dire que vous devriez simplement utiliser Octoparse, car Apify peut également évoluer à grande échelle.

Et il possède un vaste écosystème d’actors qui peut vous faire gagner beaucoup de temps, donc cela dépend de ce que vous faites et des fonctionnalités dont vous avez besoin.

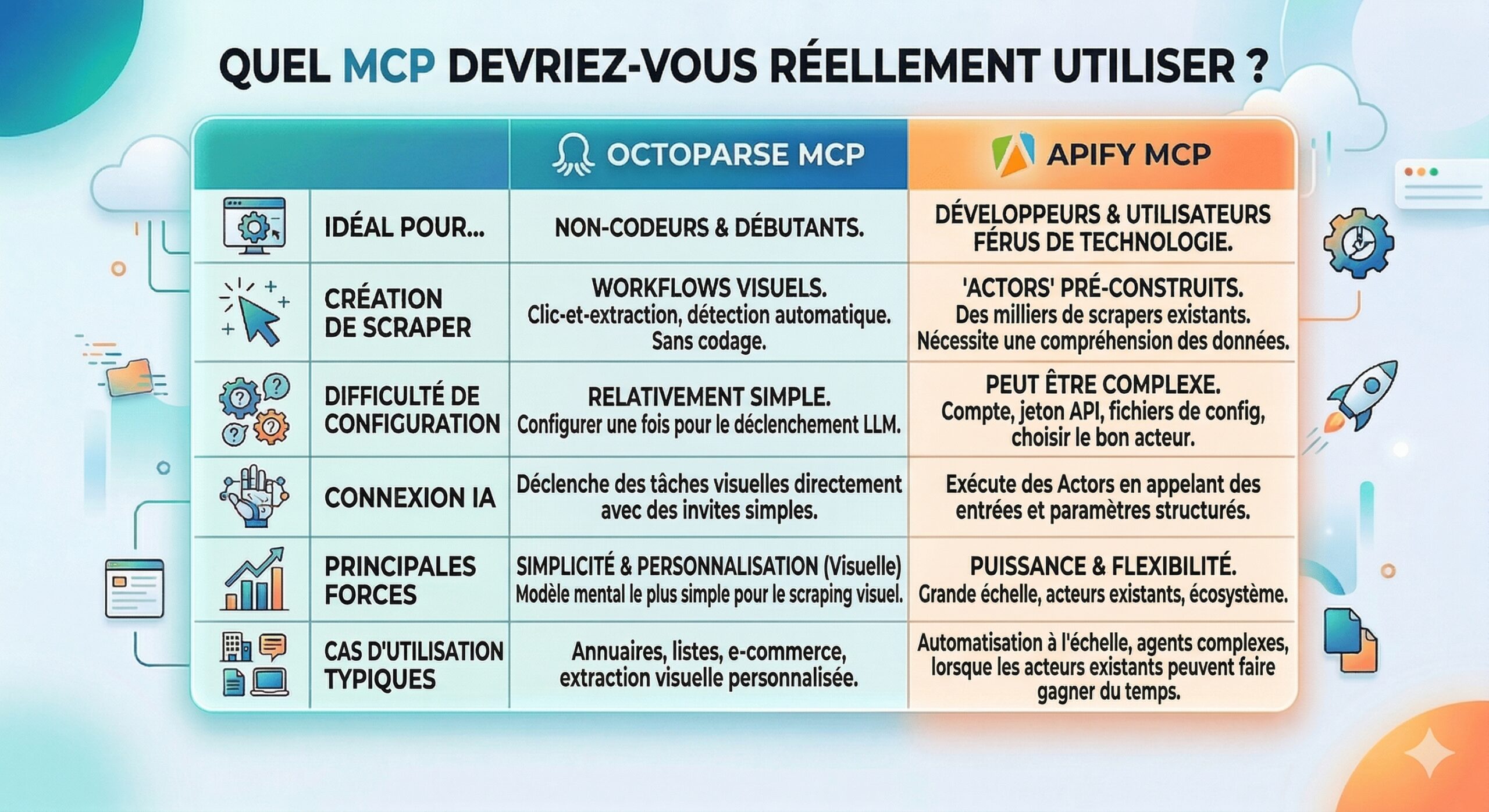

Voici donc un tableau comparant leurs fonctionnalités et plus encore :

Et maintenant, pour vous donner d’autres idées, utilisez le MCP Octoparse si :

- vous êtes un utilisateur non technique

- vous souhaitez utiliser des modèles préconçus pour tous les scénarios de scraping populaires

- vous appréciez la collecte de données à grande échelle, à haut débit, 24h/24 et 7j/7, basée sur le cloud

- vous souhaitez créer des scrapers personnalisés sans coder

- vous scrapez principalement des annuaires, des listes ou des sites web

- vous préférez une collecte de données ininterrompue avec une rotation d’IP intégrée et un contournement de CAPTCHA.

Utilisez le MCP Apify si :

- vous êtes à l’aise avec la programmation

- vous souhaitez accéder à des milliers de scrapers existants

- vous avez besoin d’une automatisation à grande échelle

- vous construisez des agents IA ou des flux de travail complexes

En d’autres termes, Octoparse se concentre sur la simplicité, tandis qu’Apify met l’accent sur la puissance et la flexibilité.

FAQ

- Faut-il savoir coder pour utiliser un serveur MCP avec un LLM ?

Pas nécessairement, et c’est précisément là que les outils divergent. Le protocole MCP lui-même est transparent pour l’utilisateur final. Ce qui compte, c’est l’outil auquel vous connectez le LLM. Avec Octoparse MCP, la configuration ne dépasse pas 3 minutes et ne nécessite aucune modification de fichier de code. Avec Apify MCP, il faut en revanche modifier un fichier JSON et gérer des tokens API, ce qui suppose une familiarité minimale avec les environnements de développement.

- Claude ou ChatGPT peuvent-ils scraper n’importe quel site via MCP ?

Non. Le LLM se contente d’appeler l’outil connecté via le serveur MCP. Ce sont les capacités de l’outil en question qui déterminent ce qui est scrapable. Octoparse gère nativement la rotation d’IP, le contournement de CAPTCHA et la détection automatique des éléments de page, ce qui couvre la grande majorité des sites courants. Si un site impose une authentification complexe ou des protections anti-bot très avancées, aucun outil ne peut les contourner automatiquement.

- Quelle est la différence entre un serveur MCP et une API classique ?

Une API classique est une intégration point-à-point entre deux systèmes. Pour chaque nouvel outil, un développeur doit construire une intégration spécifique. Le MCP propose un protocole standardisé : n’importe quel outil exposant un serveur MCP devient utilisable par n’importe quel LLM compatible, sans développement supplémentaire. C’est ce qui rend l’écosystème MCP particulièrement prometteur pour 2026.

- Peut-on utiliser Octoparse MCP avec ChatGPT, pas seulement Claude ?

Oui. Octoparse MCP fonctionne avec Claude Desktop, ChatGPT (via les connecteurs GPT), Cursor et d’autres environnements compatibles MCP. La connexion se fait via l’URL https://mcp.octoparse.com dans les paramètres du connecteur.

- Octoparse MCP est-il adapté aux besoins des entreprises françaises ?

Oui. Les cas d’usage couverts correspondent bien aux besoins des PME et ETI françaises : extraction de leads depuis des répertoires comme PagesJaunes ou Kompass, veille tarifaire sur des sites e-commerce comme Cdiscount ou Fnac, monitoring d’annonces immobilières (SeLoger, PAP.fr), ou encore analyse d’avis clients (Trustpilot.fr, Google Maps). Le scraping cloud planifié permet d’automatiser ces collectes sans maintenir une infrastructure technique en interne.

- MCP et les agents IA, c’est la même chose ?

Non, mais les deux sont liés. Un agent IA est un LLM capable d’agir de façon autonome en enchaînant plusieurs étapes. Le MCP est le protocole qui lui permet d’interagir avec des outils externes (scrapers, bases de données, APIs, fichiers). En d’autres termes, MCP est l’infrastructure qui donne aux agents IA la capacité d’agir sur le monde réel.

Ce qu’il faut retenir

Le protocole MCP a ouvert une nouvelle façon d’utiliser les LLMs pour collecter des données web. Plus besoin de jongler entre un scraper et une feuille de calcul : tout se pilote depuis l’interface de votre IA, en langage naturel.

Entre Octoparse MCP et Apify MCP, le choix se résume souvent à une question de profil :

- Vous voulez des résultats rapides sans friction technique ? Octoparse MCP est le bon point de départ.

- Vous êtes développeur et avez besoin de personnalisation avancée ? Apify MCP offre plus de flexibilité.

Pour ceux qui veulent tester sans engagement, Octoparse propose un essai gratuit qui permet de parcourir les templates disponibles et de lancer une première extraction en quelques minutes.

Télécharger Octoparse gratuitement et connecter le serveur MCP à Claude ou ChatGPT prend moins de 5 minutes au total. C’est probablement la façon la plus rapide de tester concrètement ce que le scraping piloté par IA peut faire pour votre activité.